ハーネスエンジニアリングとは?AIの生産性を最大化する設計思想

「AIエージェントで10倍〜100倍の生産性」は本当か?

ハーネスエンジニアリングとは、AIエージェントの生産性を最大化するための設計思想です。元GoogleのSteve Yegge氏が「AIコーディングエージェントを使う人は従来の10倍〜100倍の生産性を発揮する」と発言し、Y CombinatorのGarry Tan氏経由で大きな話題になりました。

この発言は嘘ではありません。ただし、ChatGPTの延長線上でAIを使っている限り、この数字は絶対に実現しません。

私はClaude Codeを2025年10月から業務の中核ツールとして使い続けています。コーディングだけでなく、記事執筆、提案書作成、競合分析、ナレッジ管理まで、ビジネスのほぼ全領域をAIエージェントと協働しています。その中で確信したのは、AIの生産性を決めるのはモデルの性能ではなく「ハーネス」の設計だということです。

この記事では、AIエージェントの生産性を引き出すハーネスエンジニアリングの考え方と、私が実際に運用している3つの制御レイヤーを具体例とともに解説します。

ハーネスエンジニアリングとは何か — AIを「レースカー」にする設計思想

ハーネスエンジニアリングの本質は、「制限することで本質的な価値を高めること」です。

レースカーに例えるとわかりやすいです。どれほど強大なエンジンを積んでいても、それだけではレースに勝てません。エンジンの力を路面に伝える躯体、コーナーで制御するサスペンション、状況に応じてパワーを調整するECU(エンジン制御ユニット)が必要です。エンジンのパワーを「制限」する場面すらありますが、結果としてゴールへの到達は速くなり、全体としての性能は向上します。

AIエージェントもまったく同じです。Opus 4.6のような最先端モデルは強大な「エンジン」を持っています。しかし、そのパワーをそのまま解放しても、方向性のない出力、ガイドラインを無視した成果物、セキュリティ上のミスが頻発します。

ハーネス(harness)とは、このエンジンを制御する「躯体」にあたるものです。CLAUDE.mdやルールファイル、Skills、Hooksといった仕組みでAIの行動を導き、制約を与え、品質を担保する。この設計全体を「ハーネスエンジニアリング」と呼びます。

なぜ今ハーネスエンジニアリングが重要なのか

AIモデルの性能は急速に向上しています。しかし、モデルが賢くなるほど「何でもできてしまう」ため、方向性を与えなければ出力の質はむしろ不安定になります。

私自身の経験でも、Claude Codeを導入した直後と、ハーネスを整備した後では成果物の品質がまるで違います。特に記事執筆やコードレビューなど、「正解が一つではないタスク」ほどハーネスの有無が品質を左右すると実感しています。

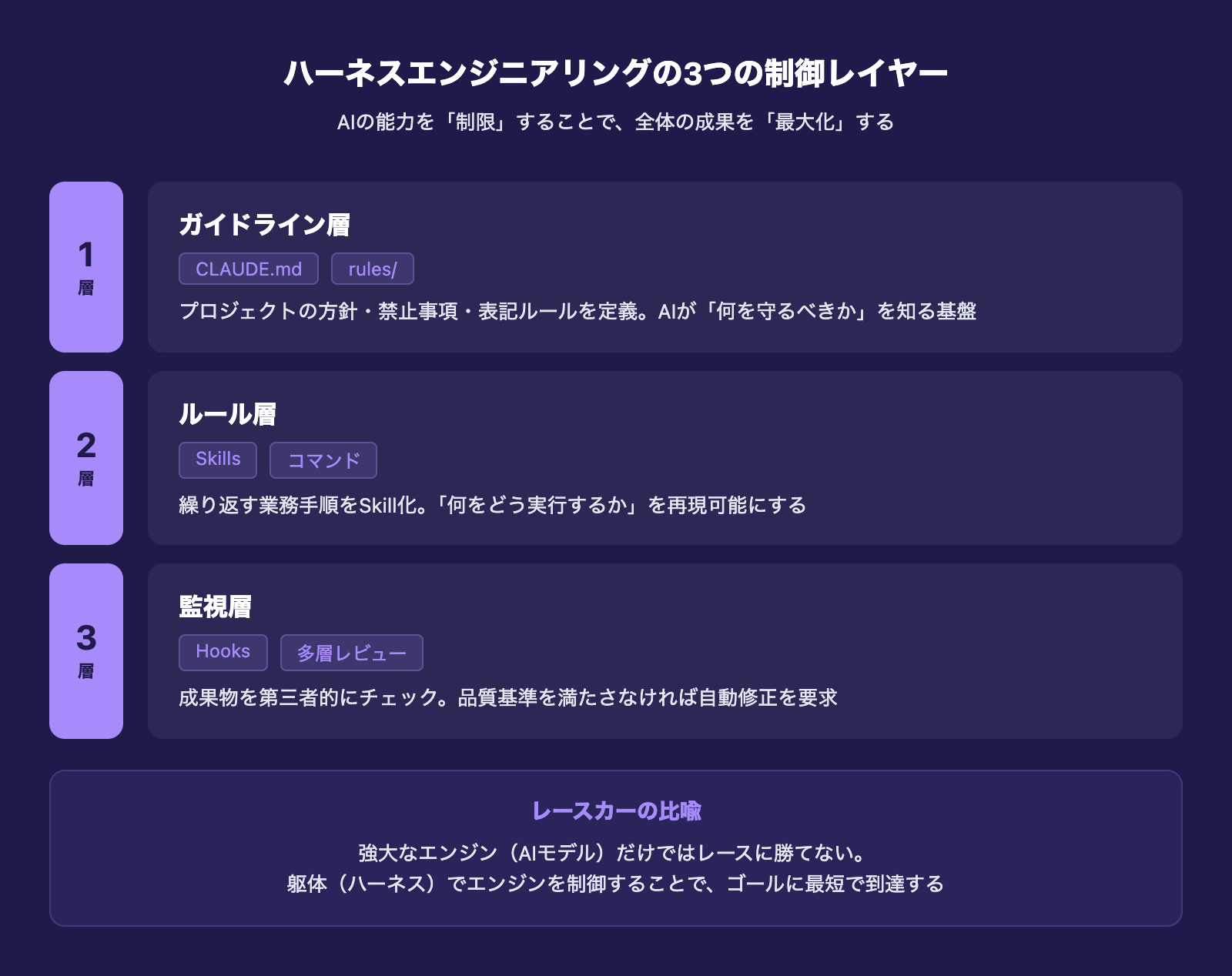

AIの生産性を最大化する3つの制御レイヤー

私が実践しているハーネスエンジニアリングは、3つのレイヤーで構成されています。それぞれが独立しながらも重なり合うことで、AIエージェントの出力品質を高めています。

第1層: ガイドライン層(CLAUDE.md・ルールファイル)

最も基盤となるレイヤーです。CLAUDE.md(Claude Codeがプロジェクト開始時に自動で読み込む設定ファイル)に、プロジェクトの方針・禁止事項・品質基準を記述します。

私のプロジェクトでは、CLAUDE.mdから以下のようなルールファイル群を参照する構成を取っています。

- 記事執筆ルール: 一人称の表記、クライアント特定防止、CTA配置の禁止など

- コーディングルール: サーバーコンポーネント優先、CSS変数ベースのデザインシステム

- ビジネスコンテキスト: サービス体系、料金、ターゲット業種の定義

- 知見蓄積ルール: どの情報をどのファイルに振り分けるかの判定基準

ここで重要なのは、CLAUDE.mdに書きすぎないことです。ある研究では、CLAUDE.mdへの記載量が一定以上になるとコンテキスト量の増加によって逆に作業精度が下がるという結果が出ています。CLAUDE.mdは「目次」的な役割に徹し、詳細は各ルールファイルに分散させるのが実用的です。

関連する運用方法はこちらの記事で詳しく解説しています。

第2層: ルール層(Skills・コマンド)

ガイドラインが「何を守るべきか」を定義するのに対し、ルール層は「どう動くべきか」を定義します。具体的にはSkills(スキルファイル)やカスタムコマンドで、繰り返す業務の手順を明文化します。

私が運用しているスキルの例を挙げます。

- SEO記事生成スキル: キーワード調査→構成設計→執筆→MicroCMS下書き投稿まで一貫実行

- GSCレポートスキル: Google Search Consoleからデータ取得→分析→改善提案を自動化

- PDF生成スキル: 提案書・診断レポートをHTML→PDFで自動生成

スキルの設計思想はReactのコンポーネント設計と同じです。共通ロジック(執筆ルール・画像生成・データ収集など)をコンポーネント化し、1箇所修正すれば全スキルに反映される保守性を実現しています。プラットフォームごとの固有ルール(SEO向け・X向け・note向け)だけを差し替える構造です。

このアプローチにより、同じ一次情報から複数のプラットフォーム向けコンテンツを品質を保ったまま生成できます。

第3層: 監視層(Hooks・多層レビュー)

3つ目の、そして最も見落とされがちなレイヤーが「第三者的な品質管理」です。

ガイドラインとスキルを整備しても、AIは一定の確率でミスをします。特に記事の言い回し、セキュリティ設定、WebサイトのSEOやインデックス設定の漏れなどは、AIが間違えやすいパターンに共通点があると気づきました。

そこで活用しているのがHooksです。Hooksとは、AIエージェントの特定アクション(ファイル保存、コミット、成果物生成など)の前後に自動的に発火する検証プロセスのことです。

具体的な運用例を紹介します。メール・提案資料・記事など公に公開するものをエージェントで作成する際、公開前に強制的に以下のチェックが走ります。

- あらかじめ定めた品質基準との照合

- 事実確認リスト(数字の正確性、クライアント特定情報の混入など)のチェック

- 表記ルール(一人称の統一、禁止表現など)の検証

人間が毎回チェックリストを目視で確認する手間を省きながら、品質の担保を自動化できる仕組みです。

多層レビューの本質 — 「人間 vs AI」ではない

AIコードレビューについても同様の考え方が当てはまります。AI単体の性能に期待するのではなく、ガイドラインを持たせた上での多層チェックが本質です。

AIにどのような方針でコードレビューをさせるかをガイドラインとして定義し、何重にも重なるチェックをそれぞれ独立した立場で実行させます。AI単体でミスが出ても、複数の独立したレビュー層が重なることで精度がはるかに向上します。

これは「人間 vs AI」という対立構図ではなく、「ガイドライン × 多層独立レビュー」という仕組みの設計こそがAIコードレビューの強みだと実感しています。

ハーネスがないとどうなるか — thinking budget問題の実体験

ハーネスの重要性を痛感した具体的な経験があります。2026年3〜4月頃、Claude Codeの「思考予算(thinking budget)」のデフォルトがmediumに変更されたことで、品質低下を体験しました。

thinking budgetとは、AIが回答を生成する前に内部で行う「考える」プロセスに割り当てるリソースの量です。これが引き下げられた結果、以下のような現象が起きました。

- 簡単なタスクでは差を感じない

- しかし複雑なコーディングや、重めのコンテキストを持たせた作業で明らかにミスが増加

- ガイドラインに沿わない出力、ファイルを十分に読まずに編集に飛びつく挙動が頻発

GitHub上のissue #42796では、6,852セッション・17,871思考ブロックの分析により、思考の深さが低下するとモデルが「調査優先」から「編集優先」にシフトする傾向が裏付けられています。

私の対策は以下の3つです。

- settings.jsonに"effortLevel": "high"を追加: デフォルトの思考予算を引き上げ。設定後、「また間違えてる」という場面はなくなった

- showThinkingSummaries: trueで思考過程を可視化: AIが何を考えているかを確認し、思考が浅い場合に気づける

- CLAUDE.mdに「読んでいないコードは変更するな」と明示: 調査を飛ばして編集に入る挙動を防止

この経験は、ハーネスなしにAIの生産性を維持することがいかに脆いかを示しています。モデルの内部パラメータが変わっただけで、同じプロンプトの出力品質が大きく変わる。だからこそ、外側からAIを制御するハーネスの仕組みが不可欠なのです。

ハーネスエンジニアリングで変わった実際の成果

AI × コンテンツ制作の「成功条件」

「AIに記事を書かせると99%失敗する」——これは事実だと思います。ただし、やり方次第で成功するというのも事実です。

失敗するのは「AIに漠然と記事を書かせる」場合です。キーワードだけ渡して「SEO記事を書いて」と指示すれば、統計的に確からしいだけの平均的で退屈な文章しか出てきません。どのAIモデルを使っても結果は同じです。

成功の条件は2つあります。

- ハーネスの整備: CLAUDE.md・Skills・ルールファイル・知見DBを事前に構築する

- 一次情報の蓄積: その人しか持っていない経験・エピソード・数字をデータベースとして整備する

私のプロジェクトでは、実績・経験データベースとAI開発ツール知見データベースを常に更新しています。AIはこれらを参照しながら記事を生成するため、「この人しか書けない記事」がAI経由で再現されます。

つまり、AIを「人間の分身」として機能させるには、属人性までコピーし得るようなコンテキスト設計が鍵になります。経験・視点・エピソードといった一次情報を構造化して蓄積し、AIが参照できる状態にしておくことで初めて、AIの出力に「その人らしさ」が宿ります。

知見蓄積が「自己進化」を生む

ハーネスエンジニアリングの副次的な効果として、プロジェクト自体が自己進化するという現象があります。

私の運用では、日々の活動・発見を月単位のlearningsファイルに蓄積し、月末に棚卸しします。重要なものは実績・経験データベースやAI開発ツール知見データベースに昇格させ、不要なものは削除します。

この運用を続けた結果、Claude Code自体のモデルが変わっていなくても、ハーネスの精度が上がることでセッションごとの出力品質が目に見えて向上しています。「自分がこう出力してほしい」という意図がガイドライン経由で反映されるようになり、修正の手間が着実に減っています。

AIが間違えるポイントは予測できる

半年以上AIエージェントと協働して気づいたのは、AIが間違えるポイントには明確なパターンがあるということです。

- 記事執筆: 禁止表現の使用、一人称の揺れ、CTA配置ルールの無視

- セキュリティ: 環境変数の直書き、認証チェックの漏れ

- SEO・インデックス設定: meta descriptionの欠落、robots.txt設定の漏れ、構造化データの不備

これらの共通エラーパターンに対して第三者的品質管理(Hooksや多層レビュー)を設定したことで、エラーの発生率は大幅に下がりました。重要なのは、「AIがミスをしないようにする」のではなく「ミスを仕組みで検出・修正する」という発想の転換です。

まとめ — ハーネスエンジニアリングの始め方

ハーネスエンジニアリングは、AIエージェントの生産性を引き出すための設計思想です。改めて3つの制御レイヤーを整理します。

- 第1層 ガイドライン層: CLAUDE.md・ルールファイルで「何を守るか」を定義する

- 第2層 ルール層: Skills・コマンドで「どう動くか」を定義する

- 第3層 監視層: Hooks・多層レビューで「品質をどう担保するか」を自動化する

Steve Yegge氏が語った「10倍〜100倍の生産性」は、このハーネスがあって初めて現実になります。AIモデル単体の性能に依存するのではなく、モデルの力を最大限に引き出す「躯体」を設計すること。それがハーネスエンジニアリングの核心です。

はじめの一歩として、まずはCLAUDE.mdにプロジェクトの基本方針と禁止事項を5〜10行で書くことから始めてみてください。それだけでも、AIの出力品質は明確に変わります。その効果を体感した上で、Skills、Hooks、知見蓄積と段階的にハーネスを拡張していくのが、最も実践的なアプローチです。

御社の業務に合わせたClaude Code導入支援

「AIツールを導入したが、現場で使われない」を終わらせる。

業務課題のヒアリングから設計、ハンズオン実践、運用定着まで一貫して支援します。