Claude Codeでテスト自動生成する実践法

Claude Codeでテスト自動生成は本当に使えるのか?実務で検証した結果

Claude Codeでテスト自動化を実現する方法を、実務で半年以上運用してきた経験から解説します。AIによるテスト生成は「使えるのか」という疑問に対して、結論から言えば、CLAUDE.mdでルールを定義し、Hooksで自動実行する仕組みを作れば、テスト工数を大幅に削減できます。

ただし「テストを書いて」と漠然と指示するだけでは、実用レベルのテストは生成できません。私が試行錯誤の末にたどり着いた、再現性のある実践手順を共有します。

なぜClaude Codeはテスト生成に強いのか

Claude Codeがテスト生成で他のAIツールと一線を画す理由は、大きく3つあります。

100万トークンのコンテキストウィンドウ

テストを正確に書くには、テスト対象のコードだけでなく、依存関係・型定義・既存テストのパターンなど、プロジェクト全体の文脈が必要です。Claude Codeは100万トークンのコンテキストウィンドウを持つため、大規模なコードベースでも文脈を見失わずにテストを生成できます。

私が運用しているNext.jsプロジェクトでは、コンポーネント・API・ユーティリティが複雑に依存し合っています。Cursorなどの補完型ツールでは1ファイル単位の補完が中心ですが、Claude Codeはプロジェクト全体を読み込んだ上で、整合性のあるテストを書いてくれます。

SWE-Bench Verifiedで80.8%の実力

Claude Opus 4.6はSWE-Bench Verifiedで80.8%を記録しています。SWE-Bench Verified(GitHubの実際のIssueを解決できるかを測るベンチマーク)は、テストの理解・生成能力と直結する指標です。

この数字が意味するのは、実際のプロジェクトで発生するバグの約8割を、コードの文脈を理解した上で修正できるということです。テスト生成においても、単にカバレッジを埋めるだけでなく、エッジケースやバグが起きやすいパターンを的確にテストケースとして書き出せます。

エージェント型だからこそできるテスト実行→修正ループ

Claude Codeはコードを書くだけでなく、ターミナルでテストを実行し、失敗したらその結果を読み取って修正するという一連のループを自律的に回せます。補完型のAIツールでは「コードを書く」までが限界ですが、Claude Codeは「テストが通るまで直す」ところまで任せられます。

テスト自動生成の実践手順

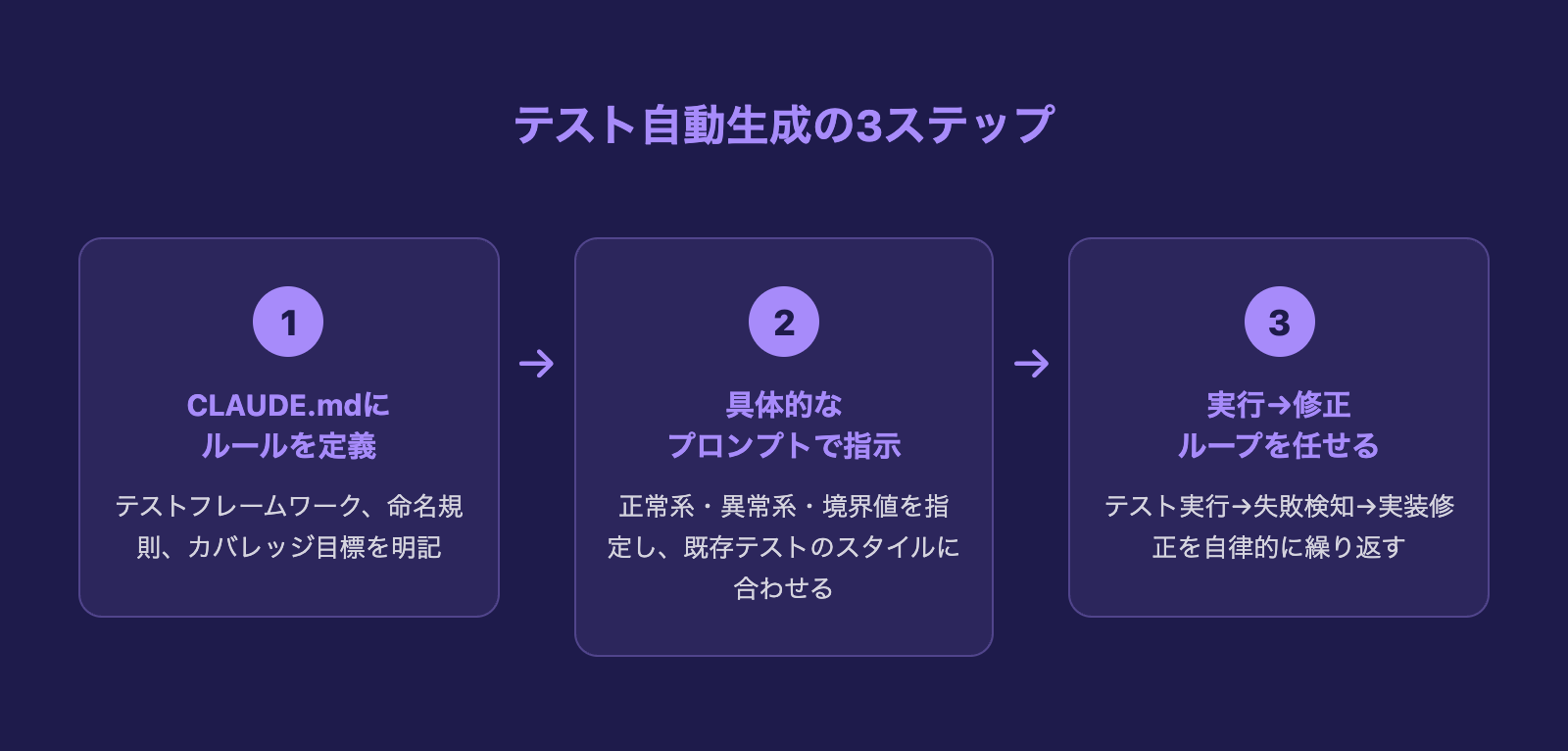

ここから、私が実務で使っているテスト自動生成の具体的な手順を紹介します。

ステップ1: CLAUDE.mdにテストルールを定義する

最も重要なのは、プロジェクトのCLAUDE.mdにテストの方針を明記することです。Claude Codeは毎セッション開始時にCLAUDE.mdを読み込むため、ここに書いたルールがすべてのテスト生成に反映されます。

私のプロジェクトでは、以下のようなルールを定義しています。

## テストルール

- テストフレームワーク: Vitest

- テストファイルの配置: __tests__/ ディレクトリ

- 命名規則: [対象ファイル名].test.ts

- カバレッジ目標: 新規コードは80%以上

- モック方針: 外部API呼び出しは必ずモック化

- テスト構造: describe → it で階層化、日本語のテスト名を使用この定義があるだけで、Claude Codeが生成するテストの品質が格段に安定します。フレームワークの選択ミスや、命名規則のブレがなくなるからです。

ステップ2: 具体的なプロンプトで指示する

「テストを書いて」では不十分です。以下のように具体的に指示します。

src/utils/formatDate.ts のユニットテストを書いて。

- 正常系: ISO文字列、Dateオブジェクト、タイムスタンプの各入力

- 異常系: null、undefined、不正な文字列

- 境界値: 1970-01-01、2099-12-31

- 既存テストの __tests__/formatCurrency.test.ts のスタイルに合わせてポイントは「既存テストのスタイルに合わせて」という指示です。Claude Codeは指定されたファイルを読み込み、テストの書き方・構造・アサーションのスタイルを揃えてくれます。プロジェクト内でテストのスタイルが統一されるため、レビューコストが下がります。

ステップ3: テスト実行→修正のループを任せる

テストを生成したら、「テストを実行して、失敗したら修正して」と指示します。Claude Codeはターミナルでnpm testを実行し、失敗したテストのエラーメッセージを読み取り、テストコードまたは実装コードを修正します。

ここで重要なのは、「テストを修正するのではなく、実装を修正して」と明示的に指示することです。Claude Codeは時々、テスト自体を修正して通そうとすることがあります。テストは仕様の記述であり、安易に変えるべきではありません。

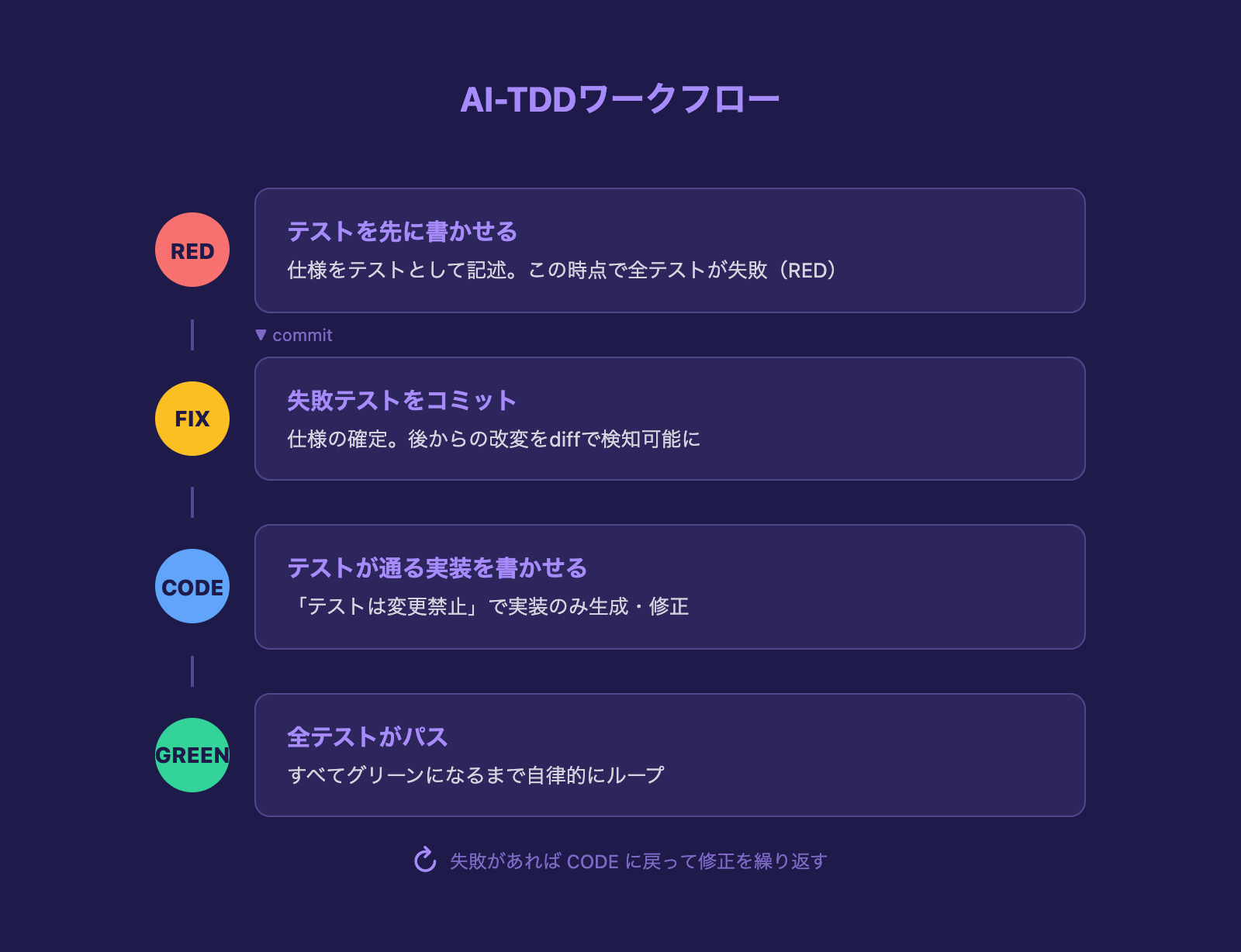

AI-TDD(テスト駆動開発)ワークフロー

私が最も効果を実感しているのが、Claude Codeを使ったAI-TDDワークフローです。従来のTDD(テスト駆動開発)をAIで加速させる手法で、以下の流れで進めます。

1. 仕様をテストとして先に書かせる

ユーザー登録APIのテストを先に書いて。実装はまだ書かないで。

- メールアドレスの重複チェック

- パスワードの強度バリデーション

- 登録成功時のレスポンス形式

- 登録失敗時のエラーレスポンスこの時点でテストはすべて失敗します。それが正しい状態です。

2. 失敗するテストをコミットする

失敗するテストをそのままコミットします。これが「仕様の確定」になります。後からClaude Codeがテストを改変して通そうとしても、diffで検知できます。

3. テストが通る実装を書かせる

さっき書いたテストがすべて通る実装を書いて。

テストは絶対に変更しないで。Claude Codeはテストを外部の仕様書として扱い、それに合格する実装を書きます。テストが通らなければ実装を修正し、すべてグリーンになるまで自律的にループします。

この方法の利点は、人間が仕様(テスト)をレビューした時点で、実装の正しさがある程度担保されることです。テストコードは実装コードよりも読みやすく、仕様のレビューに集中できます。

Hooksでテスト実行を自動化する

Claude CodeのHooks機能を使うと、特定のタイミングでテスト実行を強制できます。私はこの機能を品質チェックの自動化に活用しています。

Hooksの仕組み

Hooksは、Claude Codeのエージェントが特定のアクション(ファイル保存、コミットなど)を実行する前後に、あらかじめ定義したスクリプトを自動で走らせる機能です。CLAUDE.mdが「お願い」であるのに対し、Hooksは「強制」です。

私の運用では、記事執筆や提案資料の作成時に、公開前のチェックリスト照合をHooksで自動化しています。表記ルール・クライアント特定防止・数字の正確性などを自動で照合し、基準を満たさない箇所があれば修正指示を出す仕組みです。これと同じ考え方をテストにも適用できます。

設定例: コード変更時にテストを自動実行

// .claude/settings.json の hooks 設定例

{

"hooks": {

"PostToolUse": [

{

"matcher": "write_file|edit_file",

"command": "if echo \"$CLAUDE_FILE_PATH\" | grep -qE '\\.\(ts|tsx\)$'; then npx vitest run --reporter=verbose 2>&1 | tail -20; fi"

}

]

}

}この設定により、Claude Codeが.tsまたは.tsxファイルを変更するたびにテストが自動実行されます。テストが失敗すれば結果がClaude Codeに返され、自動的に修正を試みます。

QAスキルとの組み合わせ

私はHooksをテスト実行だけでなく、品質チェック全般に使っています。たとえば記事執筆スキルでは、エージェントが記事を生成した後に、表記ルール・クライアント特定防止・数字の正確性などを自動で照合するHooksを設定しています。

テストでも同様に、「カバレッジが基準を満たしているか」「テストの命名規則に沿っているか」といったチェックをHooksに組み込むことで、人間のレビュー負荷を下げられます。1人開発でもチーム開発並みの品質管理が実現できるのが、Claude Code×Hooksの最大の価値です。

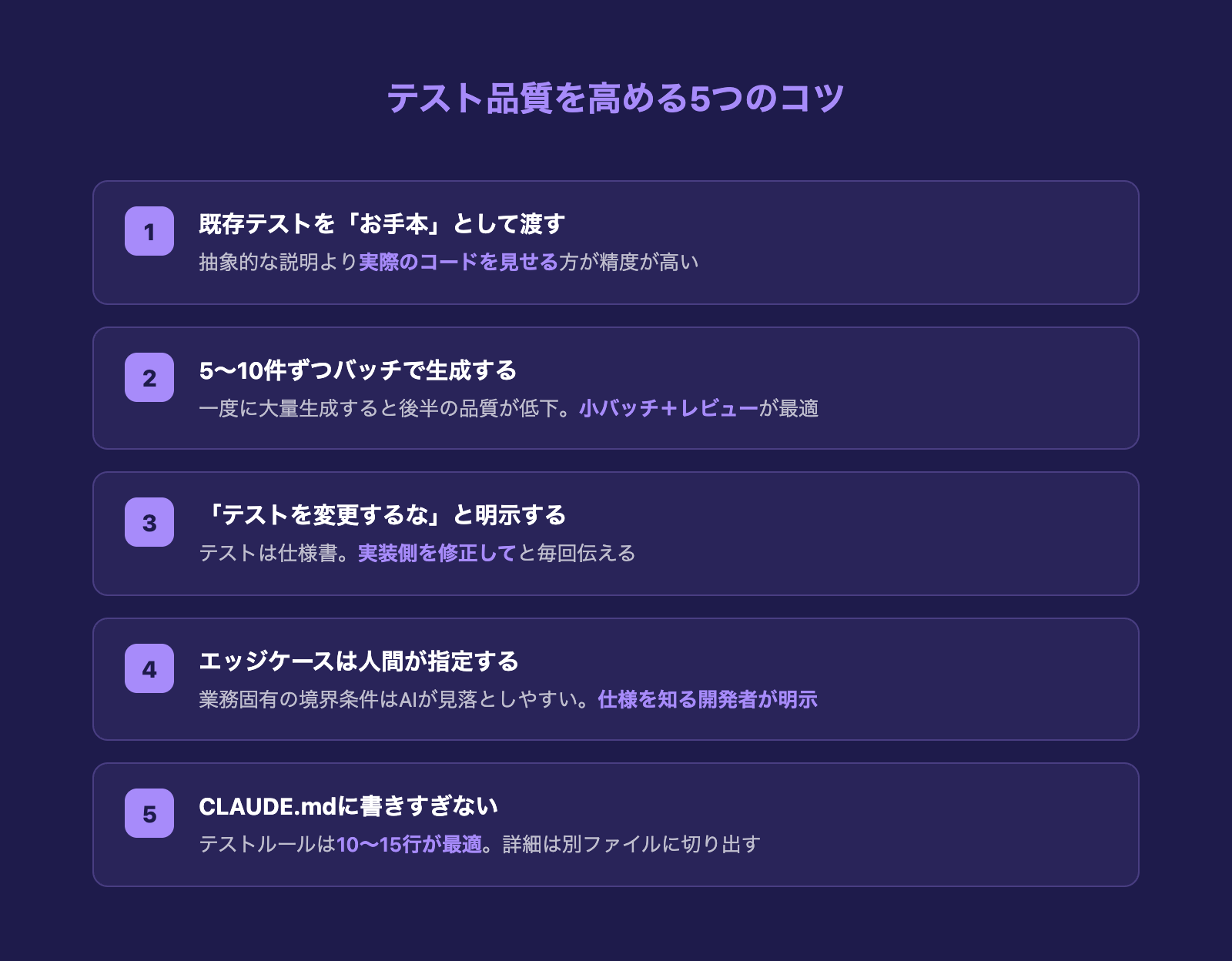

テスト品質を高める5つのコツ

半年以上Claude Codeでテストを生成してきた中で、テスト品質に直結するコツを5つまとめます。

1. 既存テストを「お手本」として渡す

プロジェクト内に良質なテストがあれば、それを明示的に参照させます。Claude Codeは参照されたテストのスタイル・構造・アサーションの粒度を学習し、同じ品質で新しいテストを生成します。抽象的な説明よりも、実際のコードを見せる方が精度が高いです。

2. テストは5〜10件ずつバッチで生成する

一度に大量のテストを生成させると、後半になるほど品質が下がります。5〜10件ずつ生成→レビュー→フィードバックのサイクルを回す方が、結果的にトータルの品質が上がります。

3. 「テストを変更するな」と明示する

前述の通り、Claude Codeはテストを修正して通そうとすることがあります。テストは仕様書です。「テストファイルは変更禁止。実装側を修正して」と毎回明記するのが安全です。

4. エッジケースを人間が指定する

AIはハッピーパスのテストは得意ですが、業務固有のエッジケース(特定の日付フォーマット、業界特有のバリデーションなど)は人間が指定する必要があります。介護記録システムでいえば「記録が0件の月」「同一利用者の重複記録」「承認後の差戻し再承認」などは、仕様を知っている開発者が明示すべきです。

5. CLAUDE.mdにテスト方針を書きすぎない

テストの方針はCLAUDE.mdに書くべきですが、書きすぎるとコンテキスト量が増えて逆に精度が落ちます。私の経験では、テスト関連のルールは10〜15行程度に収めるのが最適です。詳細なテストパターンは別ファイルに切り出し、必要なときだけ参照させる設計がベストです。

AIテスト自動化の効果を裏付けるデータ

2025年のRainforest QAの調査によると、コードベースのテスト自動化フレームワークを使うチームの75%がAIテストツールを導入しています。また、開発者の84%がAIを開発プロセスに活用しており、テスト生成とコード生成が最も改善効果が大きい領域とされています。

一方で、AIが生成したコードの採用率は約30%にとどまるというデータもあります。これはテストにも当てはまります。AIが生成したテストをそのまま使うのではなく、人間がレビューし、プロジェクトの文脈に合わせて調整することが不可欠です。

私の実感としても、Claude Codeが生成するテストの7〜8割はそのまま使えますが、残りの2〜3割は修正が必要です。ただし、ゼロからテストを書くよりも、生成されたテストをレビュー・修正する方が圧倒的に速いです。体感では、テスト作成にかかる時間が従来の3分の1程度に短縮されています。

まとめ

Claude Codeによるテスト自動化は、正しく設定すれば実務で十分に使えます。ポイントを整理すると、以下の3つです。

CLAUDE.mdにテストルールを定義することで、生成されるテストの品質とスタイルが安定します。AI-TDDワークフロー(テスト先行→実装→自動修正ループ)を採用することで、仕様の明確化とテストの網羅性を両立できます。そしてHooksで自動実行を組み込むことで、テストの実行忘れや品質基準の見落としを防げます。

AIにテストを「書かせる」だけでは不十分です。ハーネス(CLAUDE.md・Skills・Hooks)を整備し、AIが最大限の精度を発揮できる環境を作ることが、テスト自動化成功の鍵です。

関連記事

御社の業務に合わせたClaude Code導入支援

「AIツールを導入したが、現場で使われない」を終わらせる。

業務課題のヒアリングから設計、ハンズオン実践、運用定着まで一貫して支援します。