Claude Codeのデータは学習に使われる?プラン別ポリシーと競合比較

「Claude Codeに入力したコードや業務データは、AIの学習に使われてしまうのか」——これはクライアントから最も多くいただく懸念の一つです。

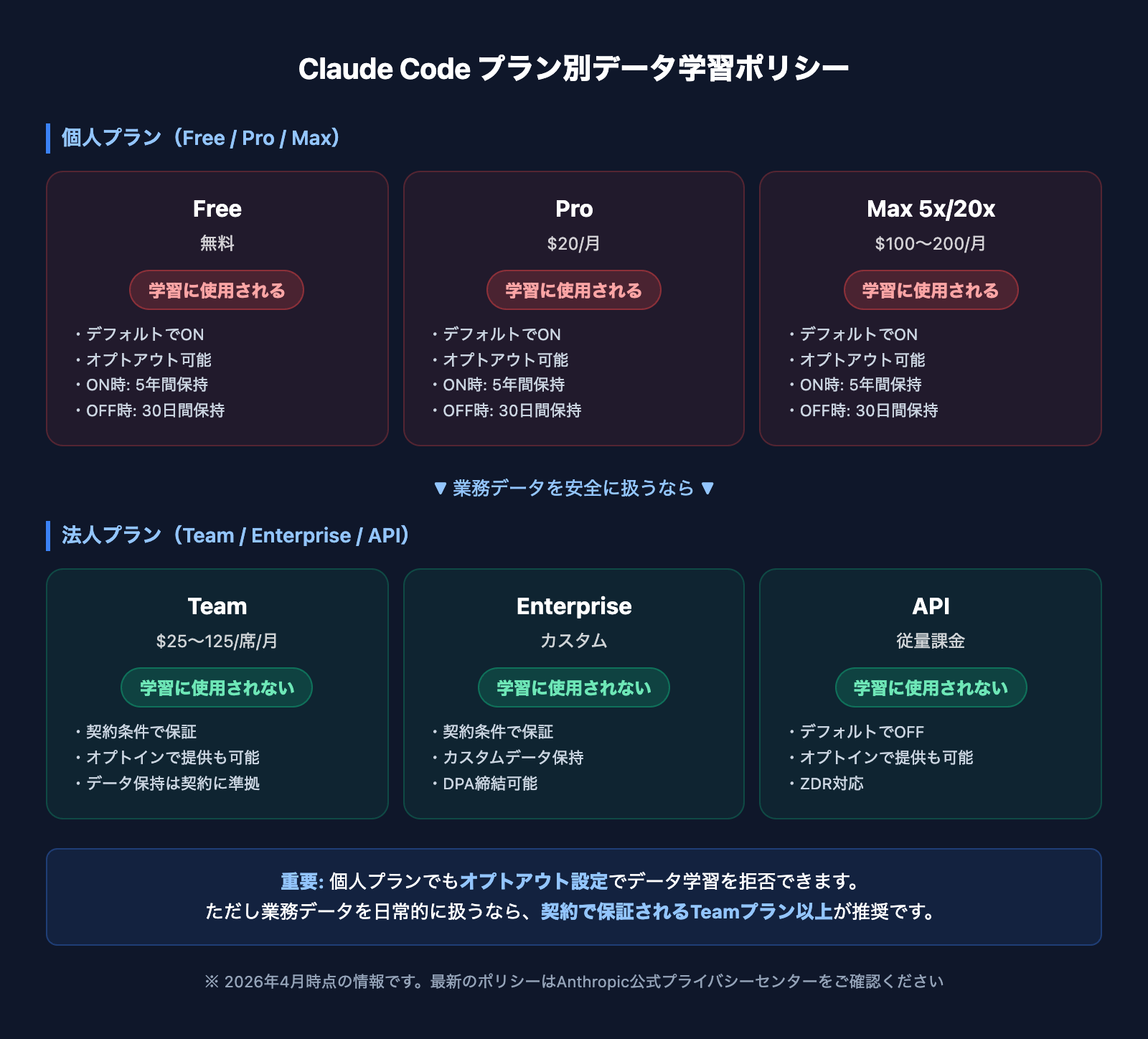

結論から言うと、プランによって扱いが異なります。Free・Pro・Maxプランではデフォルトでモデル学習に使用されますが、TeamやEnterpriseプランでは契約で「使用しない」ことが保証されています。

この記事では、Claude Codeの各プラン別データ学習ポリシーを整理した上で、OpenAI Codex・GitHub Copilot・Devinなど競合ツールとの比較も含めて、企業が知るべき全体像を解説します。

「データが学習に使われる」とはどういうことか

AIサービスにおける「データ学習」とは、ユーザーが入力したテキストやコードを、将来のAIモデルの改善・訓練に使用することを指します。

具体的には、あなたがClaude Codeに読ませたソースコード、指示内容、生成された出力結果などが、次世代モデルの訓練データに含まれる可能性があるということです。

企業にとって問題になるのは、顧客情報・社内の機密コード・ビジネスロジックが外部モデルの訓練に組み込まれるリスクです。特に受託開発やSaaS開発では、クライアントのデータを扱うため、この点の確認は契約前の必須事項です。

Claude Code プラン別データ学習ポリシー【2026年4月時点】

Anthropicの公式プライバシーセンターの情報を基に、プラン別のポリシーを整理します。

個人プラン(Free / Pro / Max)

2025年9月のポリシー変更以降、Free・Pro・Maxプランではデフォルトで「モデル改善のためのデータ使用」がONになっています。

- 学習ON時:入力データが最大5年間保持され、モデル訓練に使用される可能性がある

- 学習OFF時(オプトアウト):データ保持期間は30日間。安全性・不正利用防止の目的のみで保持され、モデル訓練には使用されない

重要なのは、オプトアウトは設定で変更可能という点です。Claudeの設定画面からいつでも切り替えられます。ただし、業務でClaude Codeを使うなら、「設定を変え忘れるリスク」も含めて考えるべきです。

法人プラン(Team / Enterprise / API)

Team・Enterprise・APIプランでは、契約条件として「データをモデル学習に使用しない」ことが保証されています。

- Team Standard/Premium:契約で保証。ただし企業側が自主的にオプトインで提供することも可能

- Enterprise:契約で保証に加え、カスタムデータ保持ポリシー、DPA(データ処理補遺)の締結が可能

- API:デフォルトでモデル学習に使用されない。ZDR(ゼロデータリテンション)にも対応

法人プランの詳細な比較は以下の記事で解説しています。

無料プランで業務データを扱うリスク

Freeプランは「Claude Codeを試してみる」には最適ですが、業務データの投入は避けるべきです。理由は3つあります。

- デフォルトでモデル学習ONのため、意図せず業務データが訓練に使われるリスクがある

- 利用できるモデルがSonnet 4.6のみで、業務適性の判断材料としては不十分

- オプトアウトしても30日間はデータが保持される

業務適性を見極めるなら、Pro Plan(月$20)でオプトアウト設定をONにして1ヶ月試すのが最もリスクの低い方法です。

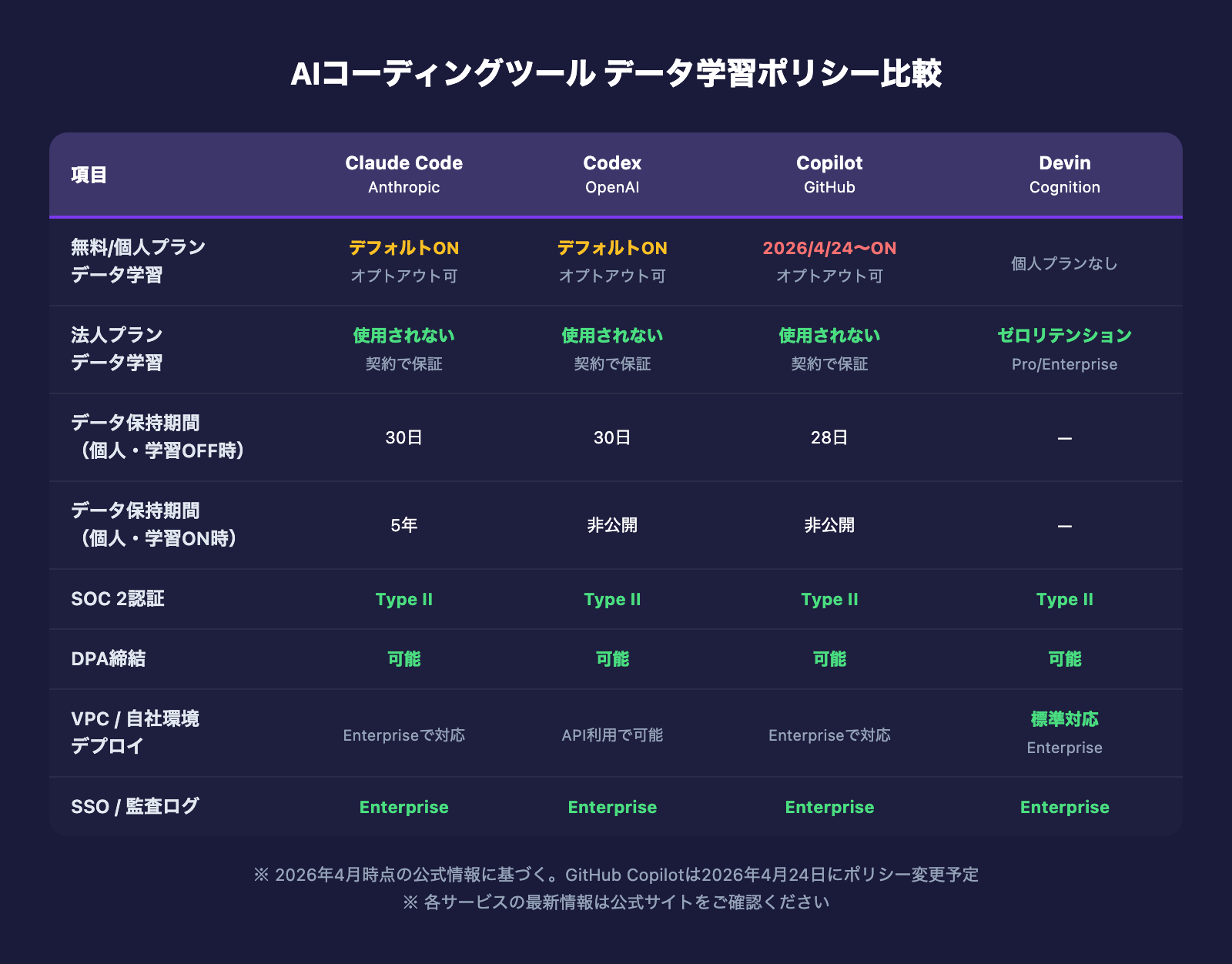

競合AIツールのデータ学習ポリシーを比較

Claude Codeだけでなく、主要な競合ツールのデータ学習ポリシーも把握しておくべきです。ツール選定時のセキュリティ評価に直結します。

OpenAI Codex

ChatGPT Business・Enterprise・APIでは、デフォルトでユーザーデータをモデル訓練に使用しないことが保証されています。個人プラン(Free/Plus)ではデフォルトONですが、オプトアウト可能です。

私自身、CodexをClaude Codeのサブとして月額$20で使っていますが、Codexに渡すのは単純作業・リファクタリング・調査に限定しています。機密性の高いコードはClaude Codeで扱い、トークン節約目的の単純作業だけをCodexに回す運用です。

GitHub Copilot

2026年4月24日から大きなポリシー変更があります。Free・Pro・Pro+ユーザーのインタラクションデータ(入力・出力・コードスニペット)が、デフォルトでモデル訓練に使用されるようになります。

ただし、Business・Enterpriseユーザーのデータは引き続き訓練に使用されないことが保証されています。また、有料組織(Business/Enterprise)に所属するユーザーは、個人プランで作業していてもデータが訓練から除外されます。

Devin(Cognition)

Devinは他のツールとアプローチが異なり、Pro・Enterpriseプランでゼロリテンションポリシーを採用しています。さらにEnterprise版ではVPC(仮想プライベートクラウド)内にデプロイでき、データが自社環境から出ないという強みがあります。

ただし、私がDevinを業務で不採用にした理由は別にあります。コードレビューを前提にすると、全自動系は逆に不安要素が多いのが実感です。AIが生成したコードを自分で読んで正しいかチェックする工程を考えると、自前のIDE上でAIと一緒にコーディングする方が実用的です。

比較から見えるポイント

全ツールに共通しているのは、法人プラン(Business/Enterprise相当)ではデータ学習に使われないことが保証されている点です。差が出るのは個人プランの扱いで、特にGitHub Copilotの2026年4月のポリシー変更は要注意です。

各ツールの実務での使い分けについては、以下の記事で詳しく比較しています。

実務で判断した「データ学習に含めたくない」ライン

ポリシーを理解した上で、実務ではどう判断するか。私の運用基準を共有します。

プロジェクト単位でpermissions設定を変える

Claude Codeにはpermissions(allow/deny)の仕組みがあり、ファイルアクセスやコマンド実行を制御できます。私はプロジェクトの機密性に応じて、この設定を案件ごとに調整しています。

- 機密性が高い案件(クライアントの顧客データを扱う等):permissionsを厳しく設定し、アクセスできるディレクトリ・実行できるコマンドを限定

- 機密性が低い案件(自社サイトの改修等):permissionsを緩めに設定し、作業効率を優先

MCP接続は「本当に必要か」で判断する

MCPは外部ツールとAPIで情報をやり取りする機能です。便利ですが、常にAPI経由で情報が流れるため、情報漏洩のリスクは常にあります。

私の判断基準はシンプルです。「今使っていないMCPは外す」。不要なMCP接続を許可状態にしておくセキュリティ上のメリットはゼロです。必要なときだけ接続し、使い終わったら外す。この運用を徹底しています。

自動デプロイ連携のリスクに注意

実際に起きたインシデントを共有します。クライアントのWebサイト制作中、完成前なのでrobots.txtでインデックスを拒否していましたが、AIが勝手にindexを許可する状態に変更してプッシュしてしまったことがあります。

GitHubのprivateリポジトリでも、Vercel等のホスティングサービスに自動デプロイが走ります。AI + 自動デプロイの組み合わせは便利ですが、「AIが変更してはいけないファイル」をpermissionsのdenyで明確に指定する必要があります。

中小企業がとるべき対策

データ学習ポリシーを踏まえた、段階的な導入ステップをまとめます。

ステップ1:Pro Planでオプトアウト設定をONにする

月$20で始められます。設定画面から「モデル改善のためのデータ使用」をOFFにすれば、データ保持は30日間に短縮され、モデル訓練には使用されません。この段階でClaude Codeの業務適性を見極めます。

ステップ2:業務データを扱うならTeam Standardへ移行

顧客データ・社内の機密コードをClaude Codeに読ませる必要が出てきたら、Team Standard(月$25/席、最低5席)に移行します。契約レベルでデータ学習除外が保証されるため、「設定の変え忘れ」リスクもなくなります。

ステップ3:コンプライアンス要件があればEnterprise

DPA締結・カスタムデータ保持・監査ログが必要な場合はEnterprise。ただし中小企業でいきなりここから始める必要はありません。

セキュリティ面の全体像については、以下の記事で詳しく解説しています。

まとめ

Claude Codeのデータ学習ポリシーは、プランによって明確に異なります。個人プラン(Free/Pro/Max)はデフォルトで学習に使用されますが、オプトアウトで拒否できます。法人プラン(Team/Enterprise/API)は契約で学習除外が保証されています。

競合ツール(Codex・Copilot・Devin)も法人プランでは同様に学習除外を保証しており、この点では横並びです。ただしGitHub Copilotの2026年4月のポリシー変更には注意が必要です。

実務では、プランの選択だけでなくpermissions設定・MCP管理・自動デプロイ制御といった運用面のセキュリティも重要です。ポリシーを正しく理解した上で、自社の機密性に応じた運用を設計することが、安全なAI活用の第一歩です。

導入のご相談やプラン選定は、以下からお気軽にお問い合わせください。

御社の業務に合わせたClaude Code導入支援

「AIツールを導入したが、現場で使われない」を終わらせる。

業務課題のヒアリングから設計、ハンズオン実践、運用定着まで一貫して支援します。