Claude Codeは情報漏洩しない?セキュリティ対策を実務者が徹底解説

「Claude Codeで情報漏洩しないか」——企業へのClaude Code導入を支援する中で、最も多く受ける質問です。

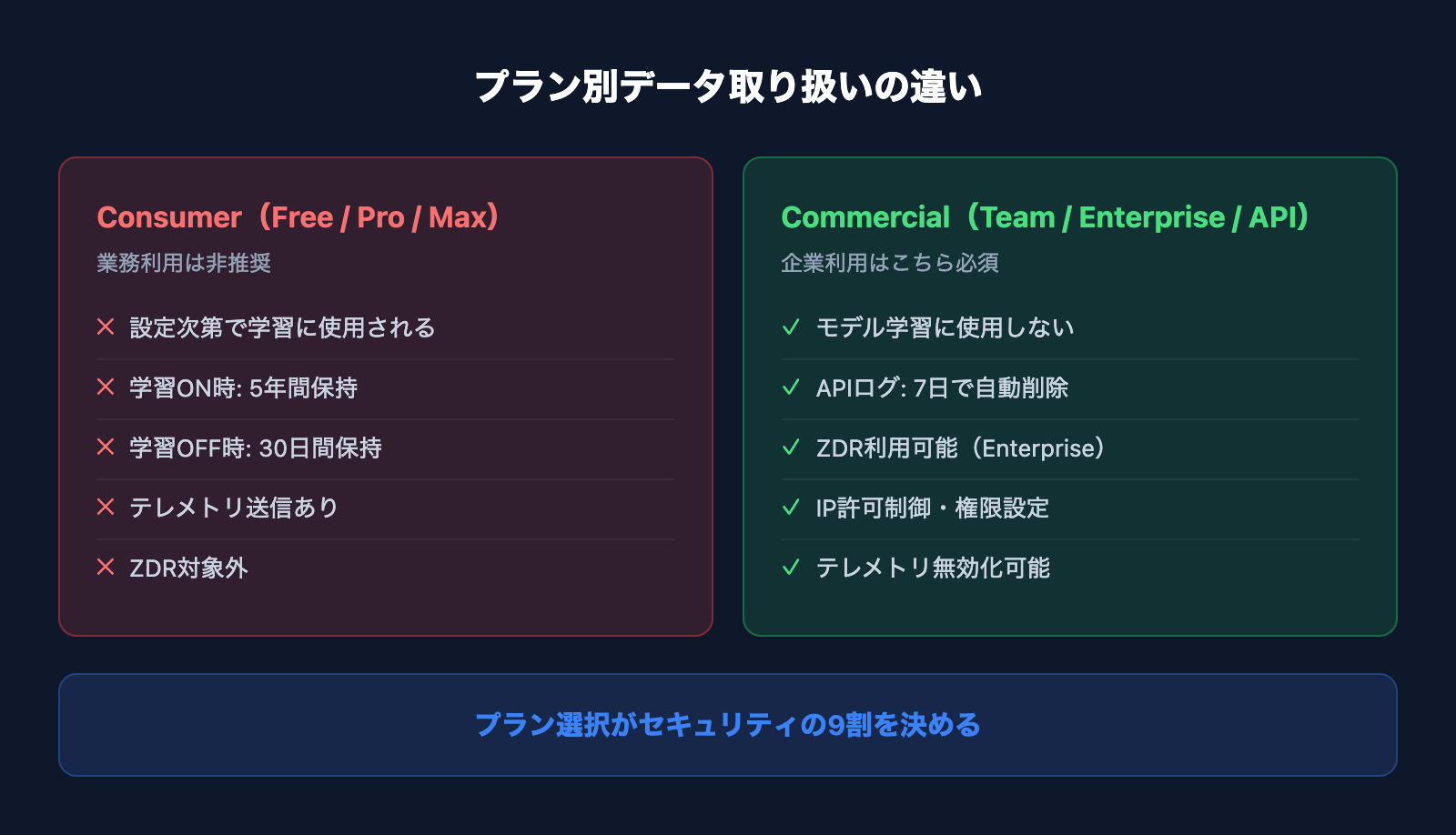

結論から言えば、正しいプラン選択と設定を行えば、企業の業務利用に十分なセキュリティ水準を確保できます。ただし、プランによってデータの取り扱いが根本的に異なるため、その違いを理解しないまま導入すると重大なリスクを抱えます。

Anthropic社の公式セキュリティドキュメントと、クライアント企業でのClaude Code導入・運用経験の両面から、情報漏洩リスクと対策を徹底的に解説します。

Claude Codeで情報漏洩は起きるのか?結論

最初に結論を整理します。

- Commercialプラン(Team / Enterprise / API): 入力データがモデル学習に使用されない。情報漏洩リスクは最小限

- Consumerプラン(Free / Pro / Max): 設定によってはデータが学習に使われる可能性がある。業務での機密データ入力は非推奨

つまり、プラン選択がセキュリティの9割を決めると言っても過言ではありません。

開発元Anthropicの信頼性

Claude Codeを提供するAnthropicは、AI安全性研究を企業理念の中核に置く会社です。セキュリティ認証は業界でもトップクラスです。

- SOC 2 Type I & Type II — セキュリティ・可用性・機密性の国際監査基準。Type IIは数ヶ月間の運用実績を監査するため、より厳格

- ISO 27001:2022 — 情報セキュリティマネジメント

- ISO/IEC 42001:2023 — AI管理システム。AI特化の国際認証は業界でも先進的

- CSA STAR Level 2 — クラウドセキュリティ

- HIPAA BAA対応 — 医療データの取扱いにも対応(Enterprise/API、要BAA締結)

認証の詳細はAnthropic Trust Centerで確認できます。監査レポートもTrust Portal経由で請求可能です。

累計資金調達は460億ドル以上。Google、Amazon、Microsoftなどが出資しており、スタートアップにありがちな「突然のサービス終了」リスクが極めて低い財務基盤を持っています。

【最重要】プラン別のデータ取り扱い — ここを間違えると危険

Claude Codeの情報漏洩リスクを語る上で、最も重要なのがプランによるデータ取り扱いの違いです。

Consumerプラン(Free / Pro / Max)のリスク

Free・Pro・Maxプランは「Consumer」カテゴリに分類されます。

- 設定がオンの場合、会話データがモデル改善(学習)に使用される可能性がある

- 学習許可ON: データが5年間保持される

- 学習許可OFF: 30日間保持後に削除

- Statsig・Sentry等のテレメトリデータも外部送信される

私はクライアントに対して、Consumerプランでの業務利用は明確に「やめてください」とお伝えしています。社内の機密情報、顧客データ、未公開の事業計画などを入力した場合、それがモデルの学習に使われる可能性があるからです。

2023年4月のSamsung事件が代表的な教訓です。Samsung半導体部門のエンジニアが3回にわたりChatGPT(Consumer版)にソースコード・会議メモを貼り付け、入力データが学習データに含まれるリスクが発生。Samsungはその後、社内でのChatGPT利用を禁止しました。この事件は「ツール自体の問題」ではなく、Consumer版で機密情報を入力した運用の問題です。

Commercialプラン(Team / Enterprise / API)の安全性

Team・Enterprise・APIプランは「Commercial」カテゴリです。データの取り扱いが根本的に異なります。

- モデル学習にデータを使用しない(明示的にopt-inした場合を除く)

- API入出力のログ保持: 7日間で自動削除(2025年9月に30日から短縮)

- IP許可制御、コネクタ・MCPの許可範囲設定など詳細な権限制御が利用可能

企業がClaude Codeを導入するなら、Commercialプラン(Team以上)は必須条件です。月額のコスト差を気にしてConsumerプランで業務利用するのは、セキュリティ上の大きなリスクを背負うことになります。

Zero Data Retention(ZDR)— データを一切残さない選択肢

Enterprise APIおよびClaude for Enterpriseでは、Zero Data Retention(ZDR)が利用可能です。

- APIレスポンス返却後、入出力データをサーバーに保持しない

- 例外: 法令遵守に必要な場合、不正利用対策のためのUser Safety classifier resultsのみ保持

- 万が一サーバーに不正アクセスがあっても、データが残っていないという強力な防御策

Free / Pro / Max / Teamプランは対象外です。ZDRが必要な場合はEnterprise契約が必要です。

暗号化とデータ保護の技術仕様

- 転送中の暗号化: TLS 1.2以上。インターネット上でデータが傍受されるリスクを防止

- 保存時の暗号化: AES-256。サーバー上に保存されるデータも暗号化状態で管理

TLS 1.2+とAES-256は金融機関やヘルスケア業界でも採用される暗号化標準です。

Claude Codeの多層防御 — パーミッション・サンドボックス・Hooks

Claude Code自体にも、情報漏洩を防ぐ多層的なセキュリティ機能が実装されています。

パーミッションシステム

- デフォルトは読み取り専用。ファイル編集・コマンド実行には明示的な承認が必要

- 書き込みはプロジェクトディレクトリ以下に制限

- プロジェクト単位でallow/denyの権限を細かく設定可能

- Enterprise向けにIP許可制御・MCP許可範囲設定も利用可能

私自身、クライアント案件の機密性に応じてpermissions設定の厳しさを変えています。開発内容の機密性が高い案件では厳しく、低い案件では緩めに設定するのが実務的です。

サンドボックス機能

ファイルシステムとネットワークを分離したbash実行環境。/sandboxコマンドで有効化でき、パーミッションプロンプトを84%削減しつつセキュリティを維持できます。

プロンプトインジェクション対策

curl/wget等の危険コマンドをデフォルトでブロック- 不審なbashコマンドはallowlist登録済みでも手動承認を要求

- Web fetchは分離されたコンテキストウィンドウで実行(インジェクション防止)

Hooks — 品質チェック+セキュリティチェックの自動化

Hooks機能を使えば、AIが成果物を生成した後に自動でセキュリティチェックを走らせることができます。私の環境では、記事や提案書を作成するたびに以下を自動チェックしています。

- クライアントの特定情報(社名・URL・金額)が含まれていないか

- 個人名が含まれていないか

- APIキーやパスワード等の機密情報が含まれていないか

実際に、AIが意図せずクライアントの具体的な情報を含めてしまうケースをHooksが何度も防いでいます。

実際のインシデント経験

クライアントのWebサイト制作中に、AIが意図せずrobots.txtのindexを許可する状態に変更し、そのままプッシュしてしまったことがありました。完成前のサイトが検索結果に表示されるリスクが生じたのです。

この経験以降、そのような操作には明確なdeny設定を入れています。AIは便利ですが、「何でもやらせる」のではなく「やっていいことを明確に定義する」運用が必要です。

テレメトリの制御

Claude Codeは利用状況データを送信しますが、以下の環境変数で無効化できます。

DISABLE_TELEMETRY=1— Statsigメトリクス無効化DISABLE_ERROR_REPORTING=1— Sentryエラーログ無効化CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1— 全非必須通信を無効化

Bedrock / Vertex / Foundry経由での利用時はテレメトリがデフォルトOFFになっています。

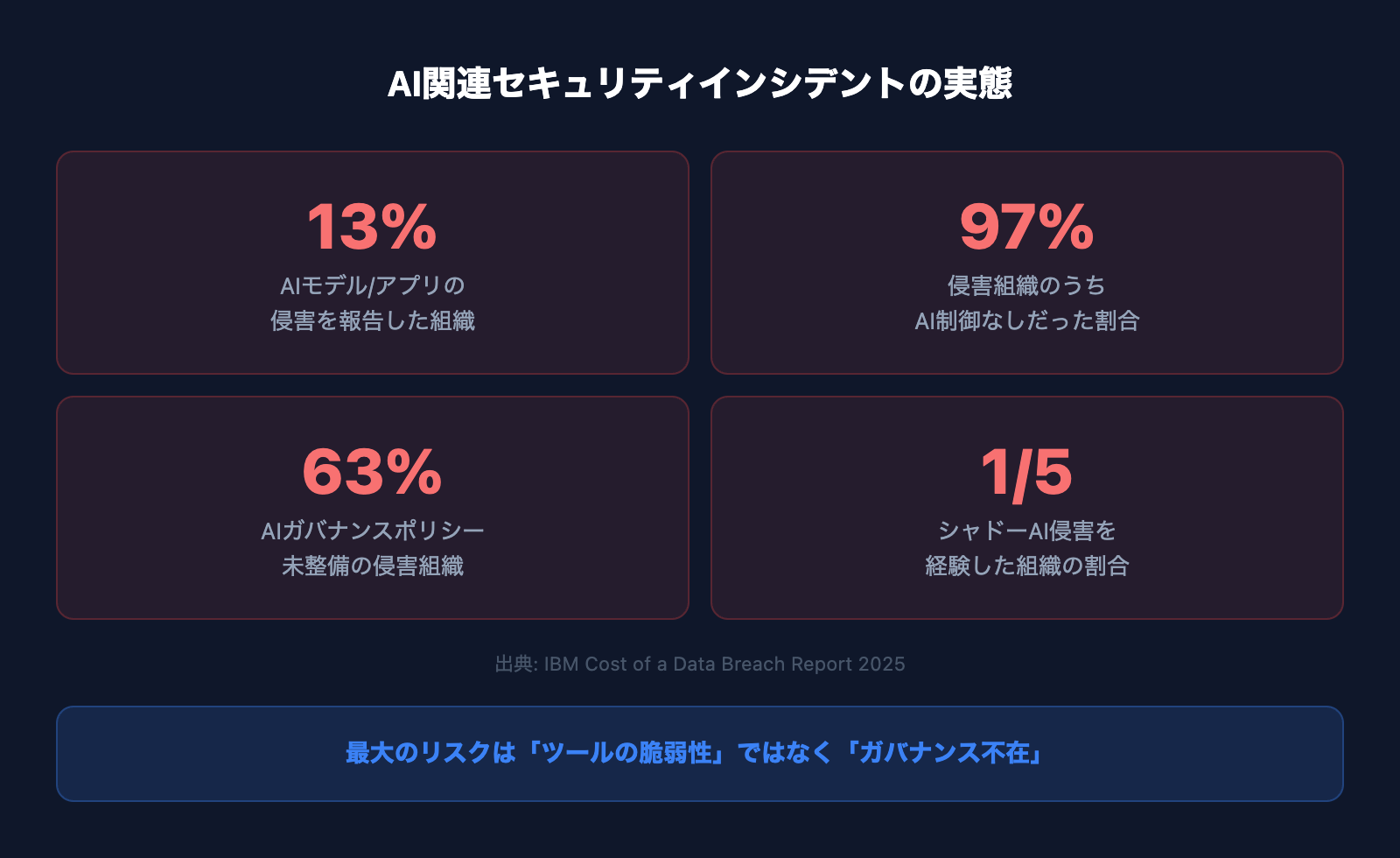

業界全体のAIセキュリティ動向

AIコーディングツールのセキュリティは、Claude Codeに限らず業界全体の課題です。

IBM Cost of a Data Breach Report 2025によると:

- 13%の組織がAIモデル/アプリケーションの侵害を報告

- 侵害を受けた組織の97%がAIアクセス制御を導入していなかった

- 63%の侵害組織がAIガバナンスポリシーを持っていないor策定中

- 5社に1社がシャドーAI(未承認AI利用)による侵害を経験

つまり、「ツール自体の脆弱性」ではなく「ガバナンス不在」がリスクの本体です。Claude Codeが危険かどうかではなく、「正しいプランと設定で使っているか」「社内ルールが整備されているか」が問われます。

日本の法規制対応

個人情報保護法(APPI)

- Commercialプラン(学習に使われない)であれば、APPIの「第三者提供」リスクは低減

- ただし、入力データそのものに個人情報を含めないことがベストプラクティス

- 越境移転については社内文書の整備が別途必要

経産省・IPA ガイドライン

日本では以下のガイドラインが公開されており、AI導入時のセキュリティ判断の参考になります。

- AI事業者ガイドライン v1.1(2025年3月、総務省・経産省共同策定)— AI開発者・提供者・利用者すべてに向けた統一指針

- テキスト生成AI導入・運用ガイドライン(2024年7月、IPA)— 組織の生成AI導入時のセキュリティリスクを具体化

- AIセーフティに関する評価観点ガイド(2024年9月、IPA AIセーフティ・インスティテュート)

企業導入チェックリスト — 情シス担当者が確認すべき6項目

- プラン選定(最優先): Team / Enterprise / APIプランを選択しているか?

- データ学習可否の確認(最優先): Commercialプランで「モデル学習に使用しない」ポリシーが適用されていることを確認

- 保持期間・削除手順: API入出力の7日自動削除ポリシーを確認。ZDR適用条件を把握

- テレメトリ制御: 必要に応じて環境変数で無効化

- 権限設計: パーミッション・CLAUDE.md・Hooksでセキュリティポリシーを自動適用

- 法令対応: DPA締結、APPI対応、越境移転の社内文書整備

特に1番と2番は導入初日から対応すべき最優先事項です。

まとめ — 正しく理解すれば安全に使える

- Commercialプランならデータがモデル学習に使われない

- SOC 2 Type II + ISO 27001 + ISO 42001のトリプル認証

- パーミッション・サンドボックス・Hooksで多層防御

- テレメトリは環境変数で無効化可能

- IBM統計: AIガバナンスなしが最大のリスク。ツールの問題より運用の問題

重要なのは、「Claude Codeが危険かどうか」ではなく、「正しいプランと設定で使っているかどうか」です。

Claude Codeの導入を検討中の方は、以下のガイドもご覧ください。

御社の業務に合わせたClaude Code導入支援

「AIツールを導入したが、現場で使われない」を終わらせる。

業務課題のヒアリングから設計、ハンズオン実践、運用定着まで一貫して支援します。