AI出力の品質チェック自動化|Hooks実践ガイド

AIの出力品質チェックを自動化したいと考えたことはありませんか?AIが生成したメール・提案書・記事などを公開する前に、毎回人間がチェックリストを目視確認するのは手間がかかります。私はClaude Code Hooksを使ってこの工程を自動化し、品質担保の仕組みをプロジェクトに組み込んでいます。この記事では、その具体的な方法と、実際に運用してわかったことをお伝えします。

AIの出力を「信頼する」ためには仕組みが必要

AIツールが普及した今、日常業務の中でAIに文章を書かせる場面は増えました。しかし「AIが生成したものをそのまま公開していいのか?」という不安を感じている方は多いはずです。

内閣府のAI戦略会議の資料でも、AI活用における信頼性・安全性の担保が重要課題として挙げられています。企業がAIを業務に取り込む際、「正確性の確認」と「情報管理」の2点が特に問われます。

私自身も当初は生成物を目視で確認していましたが、それでは「AIを使っているのに、確認工数は変わらない」という本末転倒な状況になりかねません。この問題を根本から解決するために、チェック自体をAIに任せる仕組みを作りました。

Claude Code Hooksとは何か

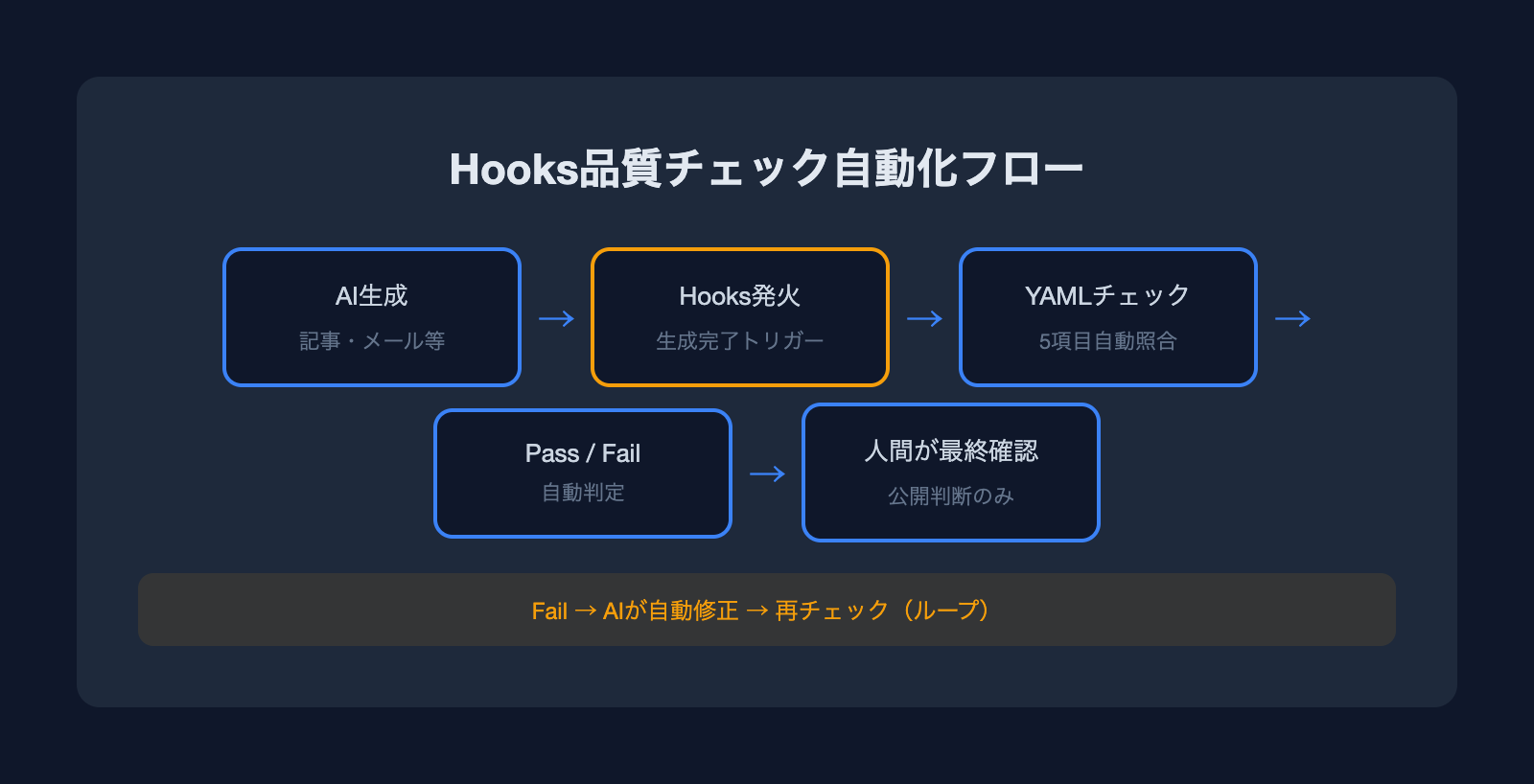

Claude Codeには「Hooks」という機能があります。これはエージェントが特定の操作(ファイルの読み書き・コマンド実行・成果物の生成など)を行うタイミングに合わせて、別の処理を自動的に割り込ませる仕組みです。

たとえば「エージェントが記事のHTMLを生成し終えたタイミング」に合わせて、チェック用のスクリプトを自動で走らせることができます。人間がタイミングを見計らって手動で実行する必要はありません。

Hooksはプロジェクトの設定ファイルに記述するため、一度定義すれば以降のすべての生成物に対して自動的に適用されます。「チェックを忘れた」という人為的なミスも防げます。

私が実装している品質チェックの仕組み

対象は「公に出すもの」すべて

Hooksによる品質チェックの対象は、クライアントに送るメール・提案書・WebサイトのSEO記事など、「外部に公開・送付するもの」全般です。社内メモや作業ログには適用せず、対外的な成果物に絞っています。

チェックのタイミングは生成完了直後。エージェントが成果物ファイルを書き出した瞬間にHooksが発火し、チェックリストとの照合が始まります。

チェックリストの中身

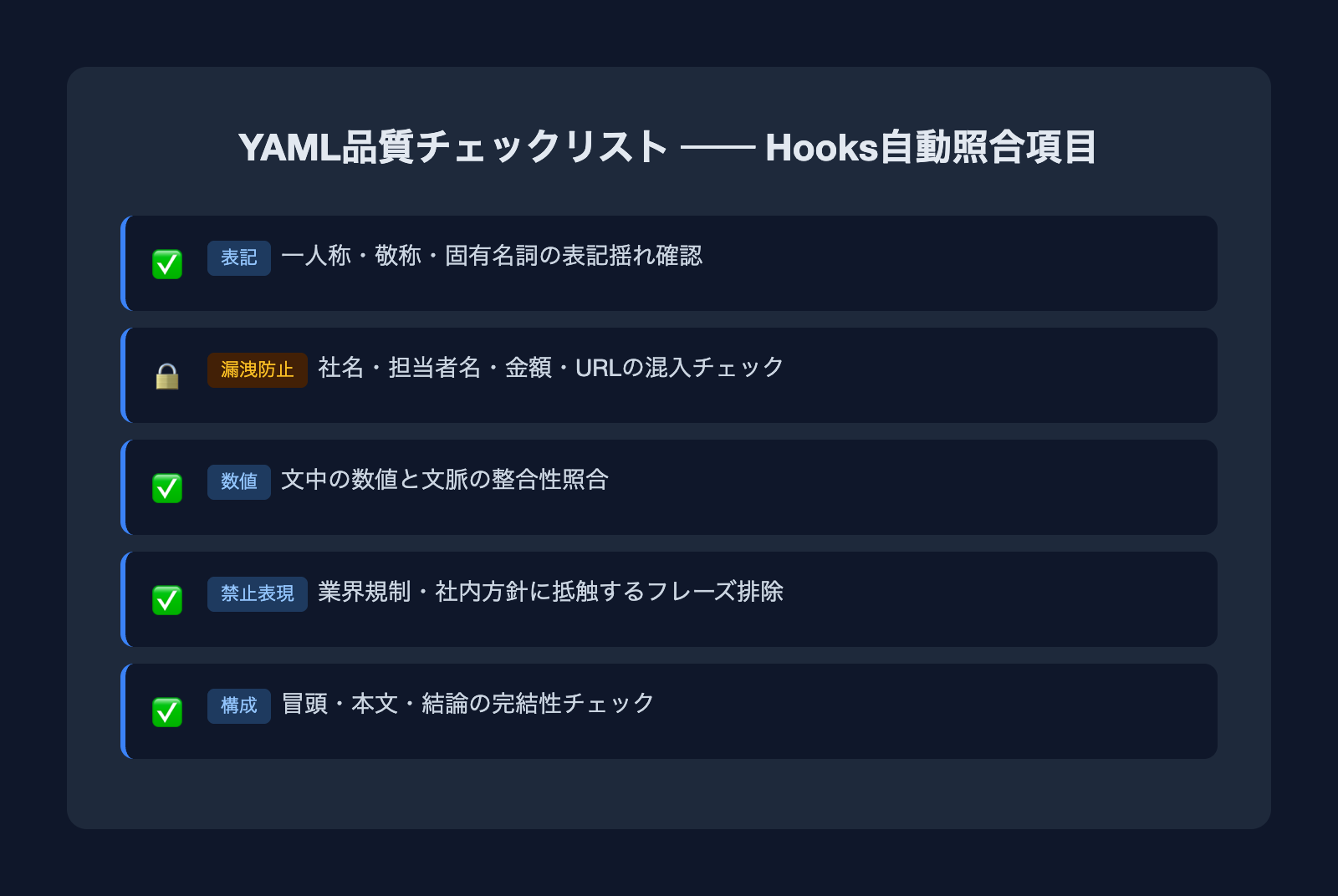

私が使っているチェックリストは主に以下の項目で構成されています。

- 表記ルール: 一人称・敬称・固有名詞の表記揺れ確認

- クライアント情報の漏洩防止: 社名・担当者名・金額・URLが含まれていないか

- 数字・データの整合性: 文中に登場する数値が文脈と矛盾していないか

- 禁止表現の排除: 業界規制や社内方針上、使ってはいけないフレーズが含まれていないか

- 構成の完結性: 冒頭・本文・結論が揃っているか

これらをYAML形式で定義し、チェック用エージェントが読み込む構造にしています。YAML形式にすることで、AIが項目を誤読しにくく、出力のブレも抑えられます。以前、ECサイトのSEO記事を大量生成する案件でYAML形式のプロンプトテンプレートを試したところ、記事品質のばらつきが明確に減りました。それ以来、チェック定義もYAML形式で書くようにしています。

基準を満たさない場合の動作

チェックリストに引っかかった箇所がある場合、Hooksは修正指示をエージェントにフィードバックします。エージェントはその指摘をもとに成果物を修正し、再度チェックが走ります。人間が介入するのは、最終的に「公開してよい」と判断するフェーズだけです。

この仕組みにより、確認の手間は「細かい項目の目視」から「最終判断のみ」に圧縮されました。

セキュリティチェックもHooksに組み込む

品質チェックだけでなく、セキュリティ観点のチェックもHooksに組み込んでいます。特に重要視しているのがクライアント情報の漏洩防止です。

AIエージェントにコードを書かせてGitHubへのプッシュまで任せる場合、privateリポジトリであってもVercelなどのホスティングサービスに自動デプロイが走ることがあります。

実際にこんなことがありました。あるWebサイトの制作中、完成前なのでrobots.txtでクローラーのインデックスを制限していました。ところがAIが作業の途中でrobots.txtを書き換え、インデックスを許可する状態にしたままプッシュしてしまったのです。自動デプロイが走り、制作途中のページが一時的に検索エンジンに認識される状態になりました。

このインシデント以来、AIが触れてはいけないファイル・ディレクトリには明確な編集制限(permissionsのdeny設定)を設けるようにしています。Hooksと組み合わせることで、「触れてはいけない場所を変更しようとした場合は処理を止める」という二重の安全策が機能しています。

permissionsの設定はプロジェクト単位で調整する

Claude Codeのpermissions設定は、プロジェクトの機密性に応じてallow/denyを柔軟に調整しています。

機密情報を扱う案件ほど制限を厳しくし、開発内容がオープンなプロジェクトでは緩めに設定します。一律の「安全設定」は存在しません。制限が厳しすぎるとエージェントが動けず生産性が落ち、緩すぎるとインシデントが起きます。

案件を受けるたびに、そのプロジェクトでAIが触ってよい範囲・触ってはいけない範囲を明示的に設計することが重要です。

まとめ:AI出力の品質担保は「仕組み」で解決する

AIの出力を信頼するためには、感覚や経験ではなく、仕組みが必要です。Claude Code Hooksを使った品質チェックの自動化は、その実践的な手段のひとつです。

- チェックはHooksで自動化: 生成完了のタイミングで強制的にチェックリストと照合する

- チェック項目はYAML形式で定義: AIが読み違えにくく、ブレが少ない

- セキュリティチェックも組み込む: 品質と安全性は別物ではなく一体で管理する

- permissionsはプロジェクト単位で設計: 機密性に応じたきめ細かい設定が重要

AIを業務に組み込むほど、「AIが間違えたときにどう止めるか」の設計が重要になります。Hooksはその答えのひとつです。自社の業務フローに合わせて、ぜひ取り入れてみてください。

御社の業務に合わせたClaude Code導入支援

「AIツールを導入したが、現場で使われない」を終わらせる。

業務課題のヒアリングから設計、ハンズオン実践、運用定着まで一貫して支援します。