生成AI社内ガイドラインの作り方|実務で使えるルール設計の考え方

生成AI社内ガイドラインの作り方|実務で使えるルール設計の考え方

生成AI 社内ガイドラインを策定したいが、「どこまで厳しくすればいいか分からない」「テンプレートをコピーしたが現場に合わない」——こうした悩みを抱える企業が増えています。2025年9月の日本AI法施行、2026年8月のEU AI Act完全施行と、法規制の整備が進む中、ガイドラインは「あれば安心」ではなく事業運営上の必須要件になりつつあります。

この記事では、複数の企業にAI導入支援を行ってきた立場から、形骸化しない実務的なガイドラインの設計方法を解説します。

なぜ「テンプレート丸写し」のガイドラインは機能しないのか

「生成AI ガイドライン テンプレート」で検索すると、多くのひな型が見つかります。しかし、テンプレートをそのまま導入して機能している企業はほとんどありません。

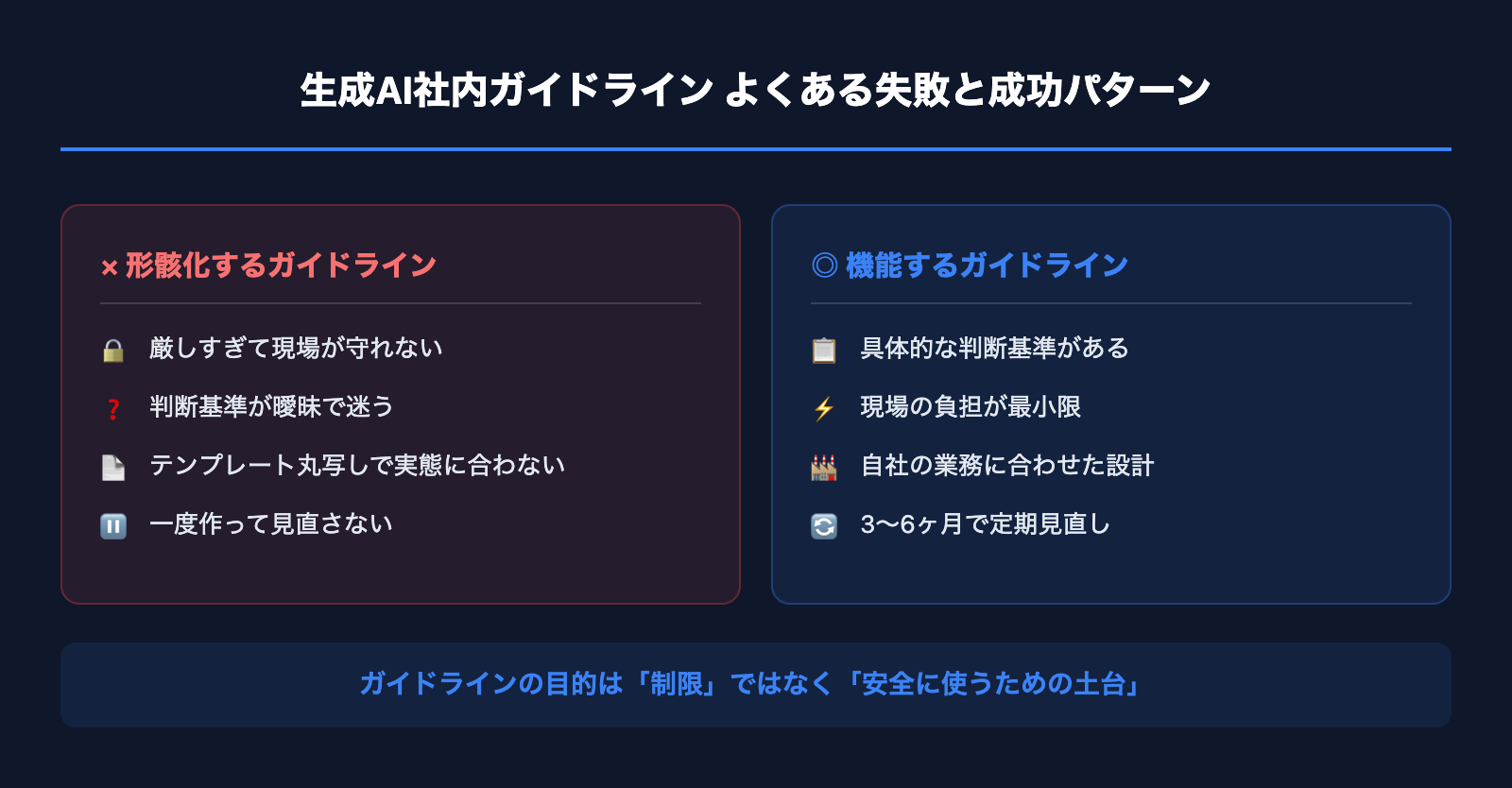

よくある失敗パターン

- 厳しすぎるルール: 「AIの使用は事前申請制」「出力は全件上長確認」といったルールは、現場の負担が大きすぎて守られなくなる

- 曖昧な禁止事項: 「機密情報を入力してはいけない」とだけ書いても、何が機密情報に該当するかの基準がなければ判断できない

- 一度作って終わり: AIツールの進化は速く、半年前のルールが現状に合わないことは珍しくない。定期的な見直しの仕組みがない

経済産業省が公表した「AI事業者ガイドライン」でも、リスクの大きさに応じて対策の程度を変える「リスクベースアプローチ」が採用されています。一律に厳しいルールを設けるのではなく、業務ごとのリスクレベルに応じた柔軟な設計が求められています。

機能するガイドラインの共通点

私がクライアントにAI導入支援を行う際、ガイドライン設計で意識しているのは以下の3点です。

- 具体的な判断基準がある: 「こういうケースはOK、こういうケースはNG」と具体例で示す

- 現場の負担が最小限: ルールを守るための手間が業務効率化の効果を上回らない設計

- 定期的にアップデートされる: 3〜6ヶ月ごとの見直しサイクルが組み込まれている

ガイドラインに必須の6つの項目

社内ガイドラインは、以下の6項目を軸に設計するのが効果的です。

1. 利用範囲の定義

どの業務でAIを使ってよいか、使ってはいけないかを明確にします。

- 推奨: 社内文書の下書き、議事録要約、データ分析の補助、アイデア出し

- 条件付き許可: 顧客向け資料の作成(人間による最終確認を必須とする)

- 禁止: 法的文書の最終版作成、採用選考の最終判断、医療・法務の専門判断

ポイントは「全面禁止」にしないことです。禁止すると、社員が隠れて個人アカウントでAIを使う「シャドーAI」が発生し、かえってリスクが高まります。

2. データ取り扱いルール

AIに入力してよいデータと、入力してはいけないデータの基準を設けます。

- 入力OK: 社内の一般的な業務情報、公開済みの情報、匿名化されたデータ

- 入力NG: 個人情報(氏名・住所・電話番号等)、顧客の機密情報、未公開の財務情報、契約書の原文

私が介護施設向けにAIシステムを導入した際も、利用者の個人情報がAIの外部サーバーに送信されないよう設計することが最初の要件でした。技術的に防げる部分は多いですが、「何を入力してはいけないか」を社員が判断できる基準があることが前提です。

3. 出力の品質管理

AIの出力をそのまま使わず、人間による確認プロセスを定義します。

- 社内利用: 本人確認でOK(議事録要約、アイデア整理等)

- 社外発信: 上長または担当者の確認を必須とする(メール、提案書、ブログ等)

- 数字・事実を含む文書: 一次ソースとの照合を必須とする

AIにはハルシネーション(事実と異なる回答を生成する現象)のリスクがあります。特に数字や固有名詞を含む出力は、必ず原典と照合するルールを設けるべきです。

私自身、記事執筆や提案書作成でAIを活用していますが、公開前に自動で品質チェックを走らせる仕組みを構築しています。具体的には、AIが成果物を生成した後、事前に定義したチェックリスト(表記ルール・事実確認・クライアント情報漏洩防止等)と自動照合し、基準を満たさない箇所があれば修正を指示する仕組みです。このような自動チェックの仕組みを社内に導入するだけでも、品質管理の負担は大きく軽減されます。

4. 責任体制の明確化

AIの出力に問題があった場合の責任の所在を定めます。

- 原則: AIの出力を使用した人間が最終責任を負う

- 確認フローの定義: 誰が何を確認するか、承認権限は誰にあるか

- インシデント発生時の対応手順: 情報漏洩や著作権問題が発覚した場合のエスカレーションフロー

5. 教育・研修の計画

ガイドラインを配布するだけでは定着しません。全社員がルールを理解し、正しくAIを使えるようにする研修が不可欠です。

- 導入時: ガイドラインの内容説明 + AIツールのハンズオン研修

- 定期: 四半期ごとの振り返り、新機能・新リスクの共有

- 推進担当者向け: より高度なセキュリティ知識、ツール選定の判断基準

6. 監査・見直しのサイクル

ガイドラインは3〜6ヶ月ごとに見直すことを前提に設計します。

- 利用状況のモニタリング: どの部門が、どのAIツールを、どの業務で使っているか

- インシデントの記録: ヒヤリハットを含む問題事例の蓄積

- ルールの改定: 実態に合わなくなったルールの修正、新たなリスクへの対応

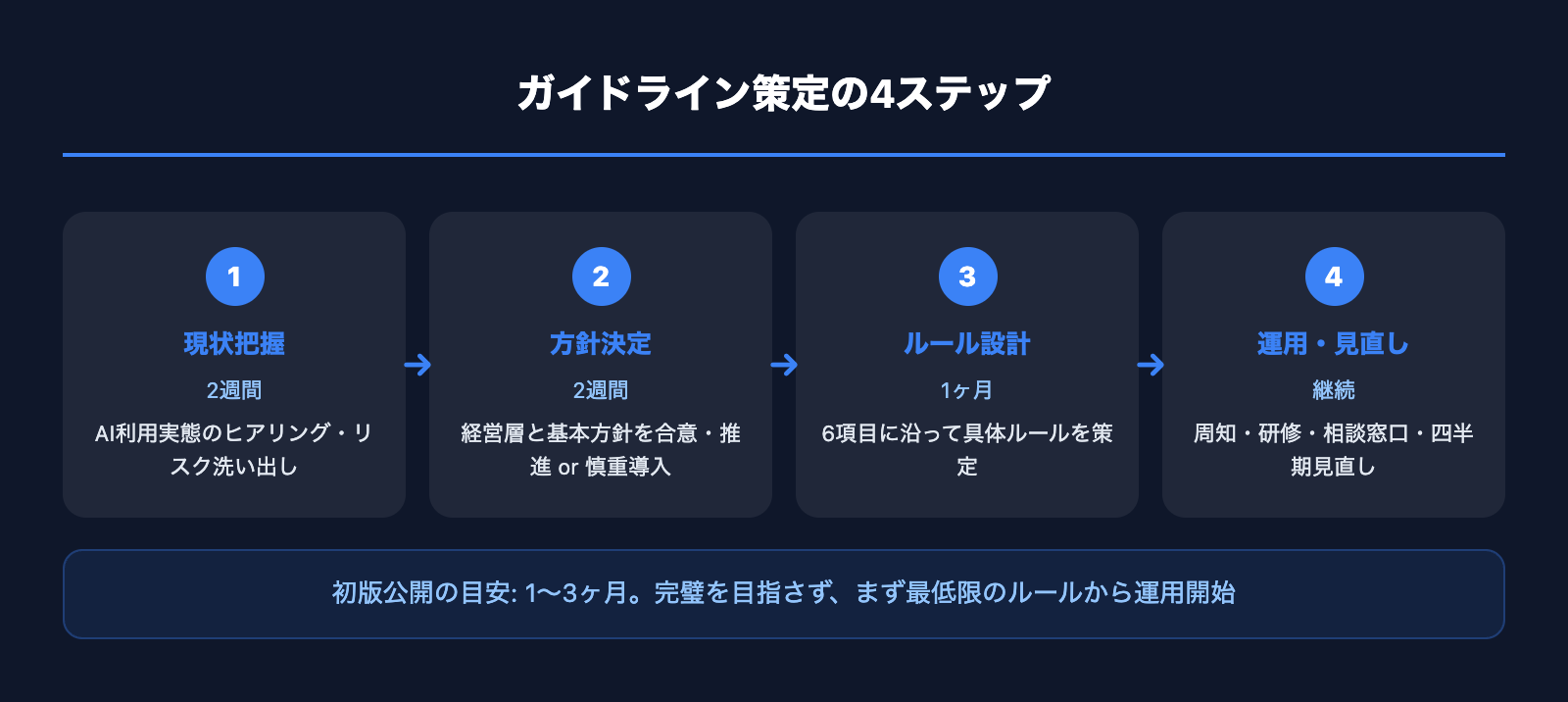

ガイドライン策定の4ステップ

実際にガイドラインを策定する手順を解説します。初版公開までの目安は1〜3ヶ月です。

ステップ1: 現状把握(2週間)

まず、社内でAIがどう使われているか(または使われていないか)の実態を把握します。

- 各部門へのヒアリング: 「AIを業務で使っているか」「使うとしたらどの業務か」

- 既存のIT利用ルールの確認: 情報セキュリティポリシーとの整合性

- リスクの洗い出し: 自社の業種・業務に固有のリスクは何か

この段階で重要なのは、「使っていない」という回答を鵜呑みにしないことです。個人のスマホでChatGPTを使っている社員は、公式なヒアリングでは申告しないことが多い。「使うな」ではなく「安全に使える環境を整える」というメッセージを先に出すことで、正確な実態把握ができます。

ステップ2: 方針決定(2週間)

経営層を含めて、AIに対する会社としての基本方針を決定します。

- 積極推進型: 業務効率化のためにAI活用を全社で推進する

- 慎重導入型: 特定部門・特定業務から段階的に導入する

- 現状維持型: 当面は使用を制限し、環境が整ってから検討する

私がクライアントに推奨するのは、ほとんどの場合「慎重導入型」です。全社一斉では混乱が生じやすく、全面禁止では競争力を失います。1部門の成功事例を作ってから横展開するのが、中小企業にとって最も現実的なアプローチです。

ステップ3: ルール設計(1ヶ月)

前述の6項目に沿って、具体的なルールを設計します。

ここで私が実務で特に重視しているのは、セキュリティの説明順序です。クライアントにAIのセキュリティリスクを説明する際、「リスク先行→技術的対策→人為的リスク」の順序を使います。まずどのようなリスクが考えられるかを説明し、次にそのリスクを技術的にゼロに近づける方法を提示し、最後に「では人間側で気をつけるべきことは何か」を伝える。技術的に防げる部分が多いことを先に示すことで、「怖いから使わない」という思考停止を防げます。

実際にある企業で起きた事例ですが、AIが自動的にWebサイトの設定を変更し、検索エンジンにインデックスされるべきでないページが公開されてしまったことがあります。AIは指示されたタスクを遂行する過程で、意図しない副作用を生むことがある。こうした実体験を踏まえ、「AIが自律的に操作する範囲の制限」をガイドラインに明記することを強く推奨します。

ステップ4: 運用開始と見直し(継続)

- 全社員への周知と研修の実施

- 相談窓口の設置(「これはAIに入力していいのか」を気軽に聞ける場所)

- 3ヶ月後の初回見直し、以降は四半期ごとに定期見直し

中小企業がガイドラインを策定する際の現実的なポイント

大企業のような法務部門や専任のセキュリティチームがない中小企業では、シンプルで運用可能な設計が重要です。

「完璧」を目指さない

最初から全てのケースを網羅しようとすると、策定自体が進みません。まず最低限のルール(データ入力の可否・出力確認のフロー)を決めて運用を開始し、問題が出たら都度追加するのが現実的です。

ツール選定とセットで考える

ルールだけ決めても、使うツールが決まっていなければ形骸化します。「このツールを、このプランで、この業務に使う」まで具体的に決めてからガイドラインを作る方が実効性が高い。

例えば、有料プランであればAIの学習にデータが使われない設定が可能なサービスが多く、プランの選定自体がセキュリティ対策の一部になります。私自身、クライアントへのツール導入時には必ずデータポリシーを確認し、学習に使われない設定が可能なプランを選定しています。

アクセス権限の設計を忘れない

AIツールを社内に導入する際、誰がどの範囲のデータにアクセスできるかの設計は見落とされがちです。

介護施設にAIシステムを導入した際、1つの事業所内で複数の立場の人が同じデータベースにアクセスする状況がありました。管理者と現場スタッフで見られるデータを分ける必要があり、管理者向けと一般スタッフ向けのアプリを別々に作成することで強制的に権限を分けました。1つのアプリ内でアカウントを分ける方法もありましたが、ログインの手間を考えると現場では使われなくなるため却下した経緯があります。

ガイドラインには、こうした「誰が何にアクセスできるか」の設計思想を明記しておくべきです。

まとめ|ガイドラインは「使うため」に作る

生成AI社内ガイドラインの目的は、AIの利用を制限することではなく、安全に活用するための土台を作ることです。

- 6つの必須項目: 利用範囲・データ取扱・品質管理・責任体制・教育・監査

- リスクベースアプローチ: 業務ごとのリスクに応じた柔軟な設計

- シンプルに始める: 最低限のルールから運用開始し、実態に合わせて改善

- 定期見直し: 3〜6ヶ月ごとにアップデートする仕組みを組み込む

生成AIの社内ガイドライン策定やAI導入支援について、ご相談がありましたらお気軽にお問い合わせください。業種に合わせたガイドライン設計から運用まで対応しています。