Date

2026/03/25

Category

AI業務効率化

Title

中小企業がAI導入する前に知っておくべきガイドラインとセキュリティ対策

中小企業のAI導入が加速する中、ガイドラインやセキュリティ対策を知らずに使い始めてしまうケースが後を絶ちません。「AIは便利そうだから」と安易に導入した結果、情報漏洩や法令違反のリスクを抱えてしまう企業も存在します。

初めまして、株式会社Fyve代表の田嶋です。ChatGPTがリリースされた初日から3年以上、毎日AIを業務に活用してきました。これまで4案件のAI開発経験と、介護施設向けシステムのセキュリティ設計(Supabase RLS、API認証等)を手がけてきた中で、クライアントから最も多く聞く声が「AIを使いたいが、セキュリティが心配」というものです。

この記事では、特に建設業をはじめとする中小企業の経営者に向けて、AI導入前に押さえるべきガイドラインとセキュリティ対策を、実践的かつ分かりやすく解説します。

なぜ今、AIガイドラインが重要なのか

2025年3月、経済産業省と総務省は「AI事業者ガイドライン(第1.1版)」を公開しました。これはAI開発者・提供者・利用者それぞれが守るべき指針を示したもので、企業規模を問わずAIを利用するすべての事業者が対象です。

さらに2025年9月には日本のAI新法が全面施行され、AIシステムの透明性確保やリスク管理体制の構築が求められるようになりました。加えて、2026年1月には改正個人情報保護法の制度改正方針が公表され、生成AIによる個人データの取り扱いに関するルールも明確化されつつあります。

つまり、「よく分からないまま使っていた」では通用しない時代に入っています。特に建設業では、顧客の個人情報・図面・見積書など機密性の高い情報を日常的に扱うため、ガイドラインへの対応は経営リスクの管理そのものです。

経産省AIガイドラインの要点を3つに整理

「AI事業者ガイドライン(第1.1版)」は内容が膨大ですが、中小企業が最低限押さえるべきポイントは次の3つです。

1. AIの利用目的を明確にする

「何のためにAIを使うのか」を社内で明文化してください。議事録作成の効率化なのか、見積書のたたき台作成なのか。目的が曖昧なまま導入すると、従業員が自己判断で機密情報を入力してしまうリスクが生まれます。

2. リスクを把握し、対策を講じる

ガイドラインでは、AIの利用に伴うリスク(情報漏洩・著作権侵害・誤情報の拡散等)を事前に洗い出し、対策を講じることを求めています。「リスクがあるから使わない」ではなく、「リスクを理解した上で正しく使う」という姿勢が重要です。

3. 人間による最終判断を維持する

AIの出力をそのまま最終成果物にしないこと。特に建設業では、AIが作成した見積書や工程表を必ず人間がチェックする仕組みを設けるべきです。ガイドラインでも「人間中心のAI活用」が基本理念として掲げられています。

ChatGPTに何を入力してはいけないのか

AI利用における最大のリスクは、情報漏洩です。実際に2023年、ある大手電子機器メーカーの従業員がChatGPTに設備情報や会議内容を入力し、情報が漏洩する事案が発生しました。また2025年2月には、2,000万件を超えるOpenAIアカウントの認証情報がダークウェブで販売されていたことも判明しています。

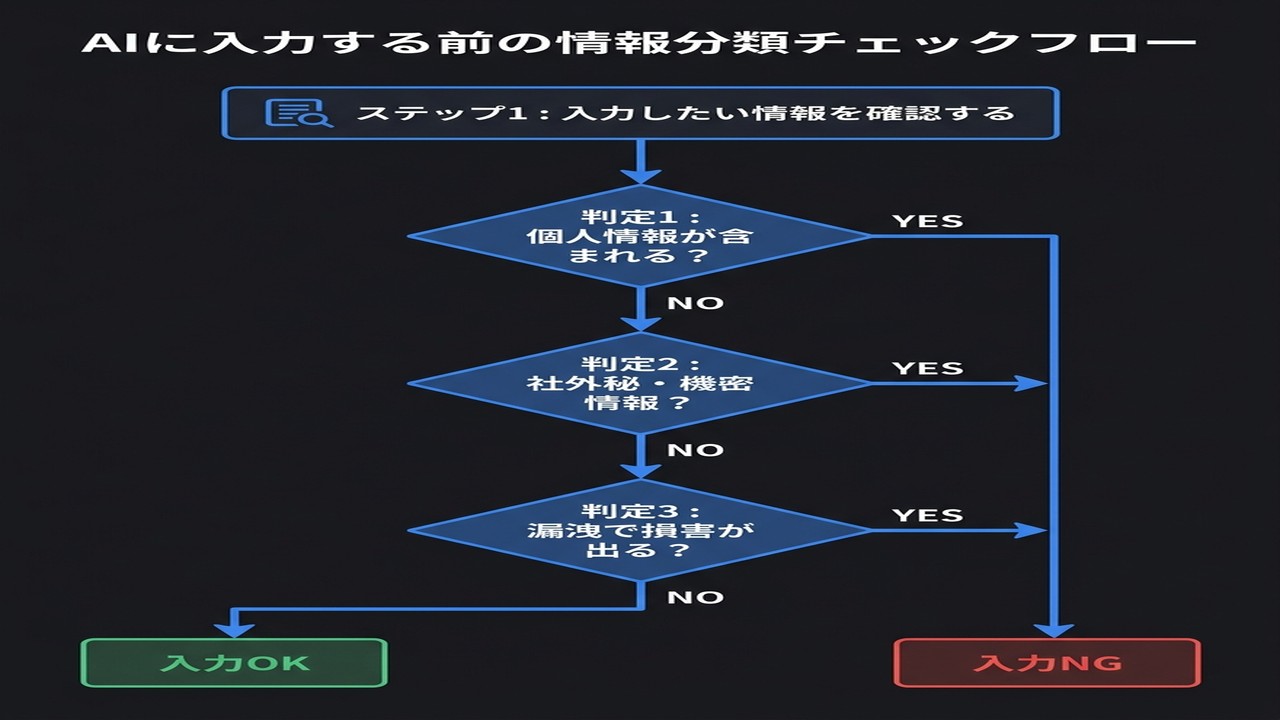

私がクライアントにAI導入を提案する際、まず作成するのが「入力OK/NG」のルールです。以下のフローチャートを参考にしてください。

建設業で特に注意すべき情報

- 顧客の個人情報:施主の氏名・住所・電話番号

- 図面データ:設計図・施工図は知的財産であり、競合に渡れば大きな損害

- 見積書の具体的金額:取引先との信頼関係に直結

- 契約書の内容:守秘義務違反のリスク

- 現場写真:位置情報や関係者の顔が写り込んでいる場合

これらの情報は、ChatGPTの無料版・有料版を問わず、そのまま入力すべきではありません。

API利用とブラウザ利用の違いを理解する

ここで重要な技術的ポイントがあります。ChatGPTには「ブラウザ版(Web版)」と「API版」の2つの利用方法があり、セキュリティレベルが大きく異なります。

ブラウザ版:入力した内容がAIモデルの学習データとして利用される可能性があります。つまり、入力した社内情報が将来的に他のユーザーへの回答に影響を与えるリスクがゼロではありません。設定でオプトアウト(学習への利用を拒否)は可能ですが、デフォルトではオンになっています。

API版:OpenAIの利用規約上、API経由で送信されたデータはモデルの学習に使用されません。企業が本格的にAIを業務に組み込む場合、API版の利用が推奨されます。

私がクライアント向けにAIシステムを開発する際は、必ずAPI経由でのアクセスを採用し、さらにアクセス制御・ログ管理・通信の暗号化を組み合わせたセキュリティ設計を行っています。介護施設向けシステム開発では、Supabase RLSによる行レベルセキュリティやAPI認証トークンの管理など、データが外部に漏れない仕組みを徹底しました。

社内AI利用ルールの作り方

ガイドラインを読んだだけでは不十分です。自社の業務に合った「社内AI利用ルール」を作成し、全従業員に周知する必要があります。

IPAの「情報セキュリティ10大脅威2026」では、「AIの利用をめぐるサイバーリスク」が初めてランクインしました。AIへの機密情報入力によるデータ漏洩リスクが、公的機関からも正式に脅威として認識されたということです。

社内ルールに盛り込むべき項目は以下の通りです。

- 利用目的の限定:どの業務にAIを使ってよいか明記

- 入力禁止情報の明示:個人情報・機密情報・図面・見積金額は入力禁止

- 利用ツールの指定:会社が許可したツールのみ使用可(シャドーIT防止)

- 出力の検証義務:AIの回答は必ず人間が事実確認する

- インシデント対応:万一、機密情報を入力してしまった場合の報告・対応フロー

- 定期的な見直し:半年〜1年ごとにルールをアップデート

オンプレミスvsクラウド:自社に合った選択

セキュリティ要件が特に厳しい企業には、オンプレミス(自社サーバー)でAIを動かす選択肢もあります。データが一切外部に出ないため、情報漏洩リスクは最小化されます。ただし、導入コストが高く、運用の技術力も求められます。

一方、クラウド型(API利用)は初期コストが低く、最新モデルをすぐに使えるメリットがあります。多くの中小企業にとっては、API利用+適切なセキュリティ対策が現実的な選択です。

判断基準はシンプルです。扱う情報の機密レベルと、かけられるコストのバランスで決めてください。建設業の場合、公共工事に関わる情報を扱う企業はより慎重な判断が求められます。

建設業でのAI活用は確実に進んでいる

「うちのような中小建設会社にAIは関係ない」と思われるかもしれません。しかし、大手ゼネコンではすでにAI活用が本格化しています。

- 竹中工務店:AI配筋検査システム「CONSAIT Eye」で、1フロア約8時間かかっていた検査をカメラ自動撮影+クラウド解析で大幅に効率化

- 清水建設:タワークレーン遠隔操縦システム「TawaRemo」で、4KカメラとLiDARによりAI補正を行い、高所作業の安全性を向上

- 大成建設:AI画像認識による打継面検査で、タブレット撮影からわずか1秒で良否判定

これらは大手の事例ですが、生成AIによる工事請負契約書の自動作成(従来120分→30分に短縮)など、中小企業でもすぐに取り入れられる活用法も広がっています。重要なのは、セキュリティを確保した上で一歩を踏み出すことです。

怖がりすぎず、正しく理解して使う

ここまでリスクや注意点を中心にお伝えしてきましたが、最も避けるべきは「怖いから使わない」という判断です。

AIは正しく使えば、中小企業の生産性を大きく引き上げるツールです。私自身、ChatGPTリリース初日から3年以上毎日使い続けてきた経験から断言できます。ただし、「何を入力してよいか」「どのツールを使うか」「出力をどう検証するか」——この3点を社内で明確にすることが前提です。

まずは以下の3ステップから始めてみてください。

- 経産省のAI事業者ガイドライン(第1.1版)に目を通す:全文を読む必要はなく、概要版だけでも十分です

- 社内AI利用ルールのたたき台を作る:本記事のチェックフローを参考に、入力OK/NGの基準を決める

- まずは情報漏洩リスクのない業務から試す:メール文面の校正、一般的な業界情報の調査など

6月に建設業者向けのAIセミナー(1.5時間)を予定しています。セミナーでは、AIのセキュリティ注意点・最新トレンド・業務効率化の実践方法を、デモを交えながら分かりやすくお伝えします。「まずは正しい知識をつけたい」という方は、ぜひご参加ください。

Company

株式会社Fyve

Address

〒810-0001

福岡県福岡市中央区天神4丁目6-28

天神ファーストビル7階

Tel

080-1460-2728

info@fyve.co.jp